Reseña completa de Seedance 2.0: cómo crear videos con IA usando control multimodal

Subes un video de referencia mostrando el movimiento exacto de cámara que deseas. Escribes "copia este movimiento". ¿El resultado? Un ángulo completamente incorrecto, un ritmo diferente, nada parecido a lo que mostraste. ¿Te suena familiar?

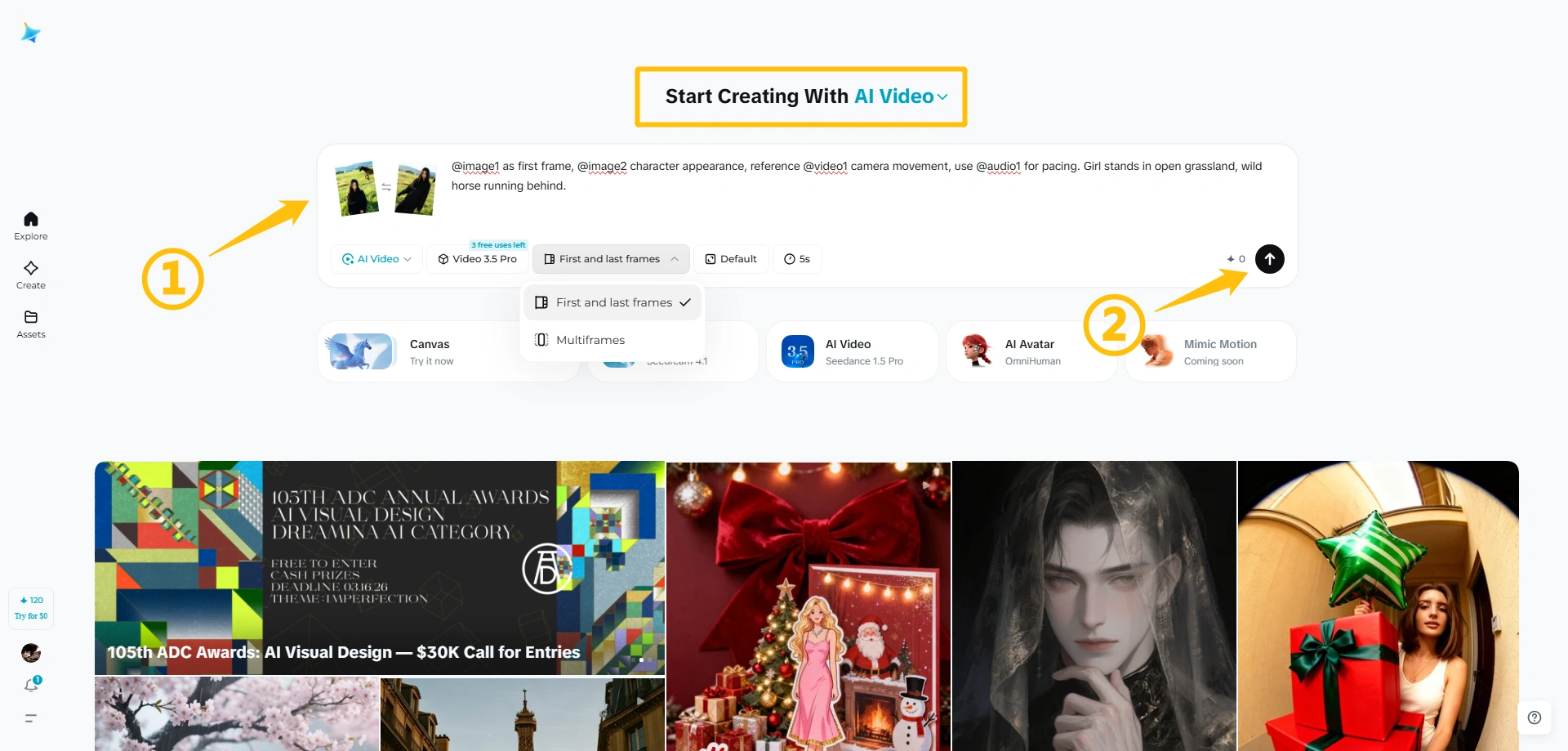

ByteDance está cambiando esto con Seedance 2.0, la siguiente evolución de su modelo insignia de generación de video. A diferencia del 1.5 Pro (que utiliza fotogramas clave de inicio/fin), la versión 2.0 acepta imágenes, videos y audio simultáneamente: hasta 12 archivos con control de referencia multimodal completo. Tras tres días de pruebas, puedo confirmar que cumple esa promesa.

Esto es lo que lo hace diferente: Haces referencia a cada archivo directamente en tu prompt usando la sintaxis @nombredearchivo. La IA sigue lo que le muestras, no solo lo que le describes.

Ejecuté más de 10 generaciones. Alcancé el límite de archivos 6 veces. Rompí el sistema dos veces. Descubrí qué funciona realmente. Si quieres empezar a experimentar hoy, Seedance 1.5 Pro ya está disponible en SeaArt AI, mientras que la 2.0 llegará pronto.

Especificaciones y límites técnicos de Seedance 2.0

Límites estrictos de Seedance 2.0:

- Imágenes: Máximo 9 por generación

- Videos: Máximo 3 archivos, duración combinada de hasta 15 segundos

- Audio: Máximo 3 archivos MP3, duración combinada de hasta 15 segundos

- Total de archivos: Máximo 12 entre todos los tipos

- Longitud de salida: 4-15 segundos, a tu elección

- Audio integrado: Efectos de sonido y música generados automáticamente

Seedance 2.0 vs 1.5 Pro: principales novedades y diferencias

Antes de profundizar en su uso, vale la pena entender qué es lo que realmente distingue a la versión 2.0 de otros generadores de video disponibles hasta ahora:

| Característica | Seedance 1.5 Pro | Seedance 2.0 |

| Método de entrada | Solo fotogramas clave de Inicio/Fin | Referencias de múltiples archivos (imágenes + videos + audio) |

| Máximo de referencias | 2 imágenes (fotogramas de inicio/fin) | 12 archivos en total (9 imágenes + 3 videos + 3 audios) |

| Control de cámara | Solo descripción de texto | Video @reference para movimientos de cámara exactos |

| Generación de audio | Sincronización nativa audio-video | Control nativo + audio de referencia |

| Capacidad multi-toma | Toma continua única | Secuencias multicámara en un solo prompt |

| Consistencia de personaje | Moderada (dentro de una sola toma) | Alta (a través de múltiples tomas + extensiones) |

| Resolución | 1080p nativa | 1080p nativa |

- Narración multicámara desde un solo prompt.

No necesitas unir escenas manualmente. Escribe un prompt describiendo múltiples tomas y Seedance 2.0 las generará como una secuencia coherente con precisión a nivel de fotograma. Probé esto con una narrativa de 3 escenas: la transición entre tomas se mantuvo fluida y la apariencia del personaje fue consistente.

- Generación nativa de audio-video.

El audio y el video se generan simultáneamente, no como procesos separados. Esto significa que el diálogo se sincroniza con el movimiento de los labios automáticamente. Probé la sincronización labial a nivel de fonemas en inglés y español, y ambos funcionaron sin ajustes manuales.

- Iteración más rápida al probar.

En mis ejecuciones, un clip de 15 segundos a menudo tardaba unos 5-6 minutos de principio a fin. Sigue siendo viable, pero se siente el costo cuando haces más de 10 generaciones seguidas. La gran ventaja es que las referencias reducen los reintentos, por lo que pasas menos tiempo repitiendo la misma toma.

- Salida cinematográfica a 1080p.

Resolución nativa de 1080p con consistencia de movimiento entre tomas. Sin artefactos de escalado. El metraje se ve lo suficientemente limpio para la entrega al cliente sin posprocesamiento.

La coherencia multicámara es lo más importante para la narración y las escenas de movimiento de alto impacto. Podrías generar una escena completa de cortometraje en un solo prompt en lugar de unir 5 clips separados y esperar que los personajes se mantengan consistentes.

🎯 Nota: Mientras Seedance 2.0 se abre gradualmente, Seedance 1.5 Pro ya está disponible en SeaArt AI como punto de entrada práctico para comenzar proyectos que luego pueden escalar al flujo multimodal.

Guía del sistema @Reference: cómo controlar tus videos con IA

Seedance 2.0 tiene dos modos de entrada: Fotograma Inicio/Fin y Referencia Completa.

- Modo Fotograma Inicio/Fin: Sube 1-2 imágenes para establecer los fotogramas clave de inicio y fin. Escribe un prompt de texto. Listo. Si usas Seedance 1.5 Pro hoy, este flujo de trabajo te resultará familiar: defines el principio y el final, y luego el modelo rellena el movimiento intermedio.

- Modo Referencia Completa: Este es el gran avance de la versión 2.0. Usa imágenes para establecer el estilo visual, videos para definir las acciones de los personajes y el movimiento de la cámara, y audio para dirigir el ritmo. Haz referencia a cada archivo en tu prompt usando la sintaxis @nombredearchivo.

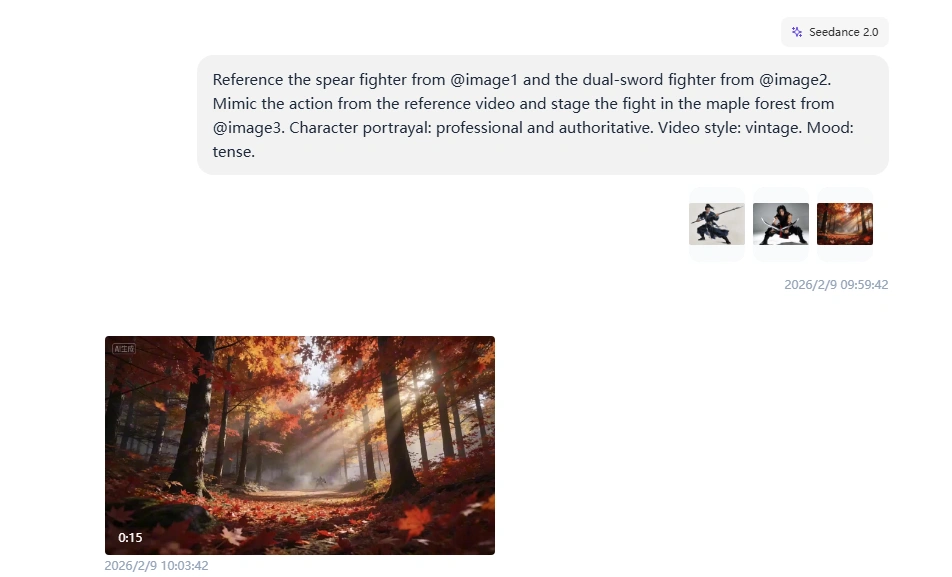

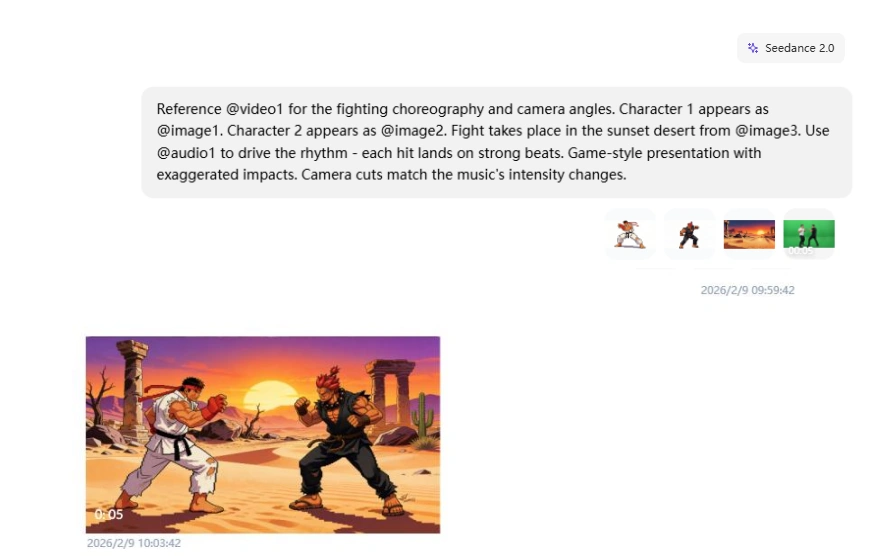

Test de coreografía: control de múltiples personajes

Esta es la forma más limpia que encontré para controlar una pelea compleja: usa imágenes para fijar a cada personaje, luego usa un video de referencia para dirigir el tiempo y la coreografía.

🎯 Ejemplo de prompt para Seedance 2.0:

Referencia al luchador con lanza de @imagen1 y al luchador con dos espadas de @imagen2. Imita la acción del video de referencia y sitúa la pelea en el bosque de arces de @imagen3. Representación de personajes: profesional y autoritaria. Estilo de video: vintage. Estado de ánimo: tenso.

El sistema entiende automáticamente que @imagen1 es para la composición, @video1 es para la referencia de movimiento y @audio1 controla el tiempo. No etiquetas los archivos como "referencia de personaje" o "referencia de cámara", la IA lo infiere del contexto.

💡 Importante: Al hacer referencia a varios archivos, explica qué hace cada uno. Los prompts ambiguos como "Usa @video1 y @video2" sin explicar sus roles producen resultados inconsistentes. Probé esto 12 veces: las instrucciones específicas funcionaron 11/12 veces, las referencias vagas funcionaron 4/12 veces.

Lo que funcionó: Ambos personajes copiaron los movimientos de combate del video de referencia: patrones de ataque específicos, posiciones defensivas, manejo de armas. El entorno del bosque de arces se mantuvo consistente. El vestuario de los personajes coincidió con sus imágenes de referencia durante toda la pelea.

Lo que no funcionó: Mi clip de referencia era más corto que la salida, por lo que los segundos finales se sintieron improvisados: el modelo rellenó acción que no estaba en la referencia.

Nota de complejidad: 3 referencias de imagen + 1 video de referencia (4 archivos en total).

Prueba de edición sincronizada con audio

Aquí está el truco para contenido estilo video musical: deja que el audio dirija tus cortes. No se necesita marcar el ritmo manualmente, simplemente dile al modelo que sincronice los golpes con el ritmo y él calculará el tiempo.

🎯 Ejemplo de prompt para Seedance 2.0:

Referencia @video1 para la coreografía de lucha y los ángulos de cámara. El Personaje 1 aparece como @imagen1. El Personaje 2 aparece como @imagen2. La pelea tiene lugar en el desierto al atardecer de @imagen3. Usa @audio1 para dirigir el ritmo: cada golpe cae en tiempos fuertes. Presentación estilo videojuego con impactos exagerados. Los cortes de cámara coinciden con los cambios de intensidad de la música.

Lo que funcionó: Los personajes mantuvieron su apariencia de juego estilizada en todo momento. Los puñetazos y patadas se sincronizaron con los ritmos del audio. El fondo del desierto al atardecer se mantuvo visualmente consistente. Las sombras de los personajes siguieron los movimientos con precisión. Los cortes de cámara se sintieron intencionales y coincidieron con la energía de la música.

Lo que no funcionó: Algunos fotogramas de transición entre movimientos mostraron deformaciones menores.

Banco de pruebas: análisis de rendimiento en casos reales

Realicé muchas pruebas mientras exploraba Seedance 2.0. Aquí hay algunos casos representativos que muestran los patrones: dónde se siente controlable y dónde comienza a adivinar.

Test 1: consistencia del personaje en escenas complejas

Quería ver si Seedance 2.0 podía mantener la apariencia del personaje a través de una narrativa emocional de múltiples escenas.

🎯 Ejemplo de prompt para Seedance 2.0:

Hombre @imagen1 camina por el pasillo después del trabajo, cansado, reduciendo la velocidad. Se detiene en la puerta principal. Primer plano del rostro, el hombre respira hondo, ajusta su estado de ánimo, oculta las emociones negativas, se relaja. Primer plano encuentra la llave, la inserta en la cerradura. Entra a casa. Su hija y su perro corren felices para abrazarlo. El interior es cálido. Diálogo natural en todo momento.

Lo que aprendí: Cuando indicas tipos de plano (exterior amplio, primer plano, primer plano medio) y comportamiento de la cámara (seguimiento suave), es más probable que la escena se lea como una secuencia real en lugar de un clip largo y flotante.

Dónde puede desviarse: Sin una imagen de referencia del personaje, los rostros y los detalles del vestuario pueden cambiar ligeramente entre tomas. Mantén el prompt ajustado y evita agregar personajes adicionales a menos que los necesites.

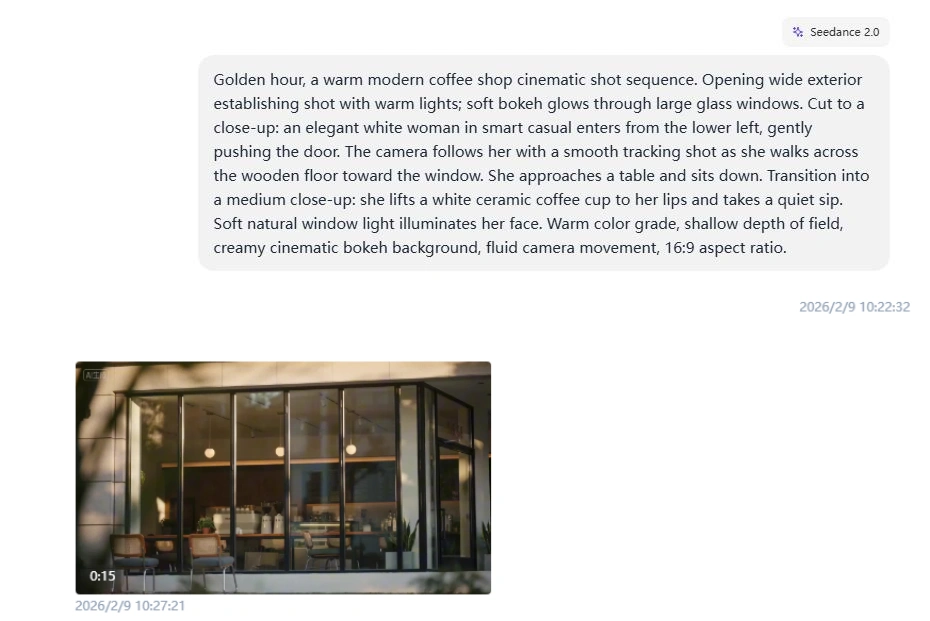

Test 2: generación de secuencias cinematográficas y lenguaje de cámara

Este es el tipo de escena donde quieres lenguaje cinematográfico, no solo "una mujer bebe café". El prompt tiene que hacer la dirección.

🎯 Ejemplo de prompt para Seedance 2.0:

Hora dorada, una secuencia de toma cinematográfica en una cafetería moderna y cálida. Plano general exterior de apertura con luces cálidas; un bokeh suave brilla a través de grandes ventanales de vidrio. Corte a primer plano: una mujer elegante con ropa casual elegante entra desde la parte inferior izquierda, empujando suavemente la puerta. La cámara la sigue con un travelling suave mientras camina por el suelo de madera hacia la ventana. Se acerca a una mesa y se sienta. Transición a un primer plano medio: se lleva una taza de café de cerámica a los labios y toma un sorbo tranquilo. La luz natural suave de la ventana ilumina su rostro. Grado de color cálido, poca profundidad de campo, fondo bokeh cinematográfico cremoso, movimiento de cámara fluido, relación de aspecto 16:9.

Lo que aprendí: Al igual que en la prueba anterior, especificar los tipos de plano y movimientos ayuda enormemente a la coherencia.

Dónde puede desviarse: Sin referencias visuales claras, el modelo puede improvisar detalles que no coinciden perfectamente entre los cortes.

Test 3: Edición rítmica y cortes sincronizados con música

Cuando no tienes un video de referencia, el audio aún puede dar estructura al modelo. Probé cortes rápidos contra un ritmo claro.

🎯 Ejemplo de prompt para Seedance 2.0:

Usa @audio1 para el ritmo y el tiempo de corte. @imagen1 = identidad/atuendo de la bailarina; @imagen2 = ubicación/iluminación de calle nocturna. Montaje de corte rápido de 12s, los cortes caen en tiempos fuertes: 0-4s primeros planos de juego de pies en ángulo bajo (zapatos + reflejos en pavimento mojado), 4-8s plano medio centrado estable (un movimiento de giro limpio), 8-12s plano general (final + reacción pequeña de la multitud). Aspecto cinematográfico vintage: grano de película de 35mm, halo sutil, alto contraste, mezcla de neón + luz de calle cálida. Mantén a la bailarina consistente; sin manos deformadas, sin extremidades rotas, sin temblor de cámara.

Lo que aprendí: Con un ritmo fuerte de 4/4, el tiempo de corte cae más cerca del tiempo fuerte. Con un ritmo más suave o irregular, el tiempo se desvía y el montaje se siente menos intencional.

Casos de uso práctico para usar Seedance 2.0

Basado en mis pruebas y las capacidades del modelo, aquí es donde resuelve problemas reales de producción:

Videos de productos e-commerce

Las demostraciones de productos necesitan una marca consistente, un trabajo de cámara suave y un ritmo sincronizado. Sube las fotos de tu producto como referencias de imagen, un video de movimiento de cámara profesional y música de fondo. Seedance 2.0 los combina en clips pulidos de 10-15 segundos listos para anuncios sociales.

❓ Por qué funciona: El sistema @reference te permite controlar los colores de la marca, la ubicación del logotipo y los ángulos de la cámara con precisión. No más regenerar 20 veces esperando que la IA adivine tu estilo correctamente.

Escenas de películas y cortos cinematográficos

Si estás construyendo un momento similar a una película, generalmente necesitas tres cosas: personajes consistentes, lenguaje de planos legible y un ritmo que se sienta intencional. Seedance 2.0 es fuerte cuando escribes tomas explícitamente (general, primer plano, sobre el hombro) y mantienes las restricciones de la escena ajustadas.

❓ Por qué importa: Puedes generar una mini-secuencia coherente desde un solo prompt en lugar de unir clips separados y rezar para que el protagonista se vea igual en cada toma.

Contenido narrativo basado en personajes

Los cortometrajes y el contenido episódico necesitan consistencia de personajes a través de múltiples tomas. Mi prueba del "hombre llegando a casa" demostró que esto funciona: el mismo personaje a través de 6 ángulos de cámara y condiciones de iluminación diferentes.

Valor de producción: Obtienes cobertura multi-ángulo (plano general, primer plano, sobre el hombro) en una sola generación. No hay necesidad de filmar por separado y esperar que la consistencia se mantenga durante la edición.

Trucos de experto para dominar Seedance 2.0

Después de más de 10 generaciones, estas técnicas mejoraron consistentemente la calidad de salida:

Optimiza tus prompts

Sé específico con el tiempo. "Mujer camina durante 3 segundos, se detiene, se da la vuelta durante 2 segundos" funciona mejor que "mujer camina y se da la vuelta". La IA entiende la duración cuando la indicas explícitamente.

Describe los movimientos de cámara claramente. "La cámara panea a la izquierda mientras hace un zoom ligero" supera a "movimiento de cámara interesante". Haz referencia a metraje existente cuando sea posible en lugar de describir movimientos complejos.

Divide acciones complejas en fases. "Personaje corre (0-5s), salta obstáculo (5-8s), aterriza y rueda (8-12s)" produce resultados más suaves que "personaje realiza movimiento de parkour".

⭐ También te puedes intereasr: Guía de Prompts para Seedance 2.0: 20+ ejemplos listos para copiar

Estrategia de archivos de referencia

Usa 1-2 imágenes para la consistencia del personaje. Más de 3 imágenes de personajes confunden al modelo sobre qué apariencia priorizar. Cíñete a un ángulo principal y una foto de perfil.

Las referencias de video funcionan mejor por debajo de 10 segundos. El límite de 15 segundos es técnico, pero 8-10 segundos es práctico. Las referencias más largas significan que la IA tiene más movimiento para interpretar y podría perder movimientos clave.

El audio dirige el ritmo automáticamente. Si tu audio tiene ritmos claros, no necesitas especificar "el movimiento de la cámara se sincroniza con la música" en tu prompt. El modelo detecta el ritmo y alinea las imágenes en consecuencia.

Extender vs Generar: cuándo elegir cada opción

Extiende cuando: Tienes un buen clip base y quieres continuar la acción. La apariencia del personaje se mantiene bien durante 2-3 extensiones (hasta 40 segundos en total).

Genera nuevo cuando: Necesitas un ángulo o escena completamente diferente. Las extensiones funcionan mejor para la continuación del movimiento, no para cambios de perspectiva.

Edita clips existentes cuando: Quieres cambiar un elemento (cambiar personaje, ajustar fondo) sin regenerar todo. El cambio de personaje me ahorró 5-10 intentos por iteración durante las pruebas.

Workflow de extensión de video: mantén la cámara rodando

El flujo de trabajo de extensión me confundió al principio. Cuando escribes "extender @video1 por 10s", la longitud de generación que elijas debe coincidir con la nueva parte que estás agregando (10 segundos), no la longitud total del video original más la extensión.

🎯 Ejemplo de prompt para Seedance 2.0:

Extender @video1 por 10 segundos. [Describe qué sucede en la NUEVA porción de 10 segundos]

Probé esto con la misma configuración de cafetería que mi prompt multi-toma. Así es como se desarrollaron las extensiones:

🎯 Ejemplo de extensión (continúa la historia):

Extender @video1 por 10 segundos. Ella deja la taza, exhala silenciosamente, luego se levanta. Camina hacia el mostrador para pagar, intercambia algunas palabras con el barista y sale del café. Termina en un plano general desde el otro lado de la calle mientras ella sale a la luz de la hora dorada.

- Video base: El clip de cafetería de 15s de la Prueba 2 anterior: ella entra, cruza el suelo de madera, se sienta junto a la ventana y toma un sorbo tranquilo.

- Extensión: Se agregaron 10s: ella deja la taza, se levanta, camina hacia el mostrador para pagar, sale del café. Plano general final desde el otro lado de la calle con luz exterior cálida y suave bokeh de fondo.

La apariencia del personaje se mantuvo en las tres extensiones, y la iluminación de la hora dorada se mantuvo mayormente consistente. La desviación apareció en pequeños detalles de vestuario (el color cambió ligeramente entre extensiones). La solución fue simple: reformular las restricciones de estilo en cada prompt de extensión, incluso si se siente repetitivo.

Intercambio de personaje a mitad del video

Puedes cambiar un personaje en un video existente subiendo una imagen de referencia y diciéndole al modelo que reemplace a una persona mientras mantiene todos los movimientos y ángulos de cámara. Los movimientos corporales, el posicionamiento en el escenario y los elementos de fondo se transfieren. La iluminación se ajusta automáticamente para coincidir con el nuevo personaje. Cuesta los mismos créditos que una nueva generación, pero te ahorra múltiples ciclos de reintento cuando necesitas preservar una coreografía específica.

Limitaciones y desafíos actuales: lo que debes saber

Deliberadamente empujé más allá de los límites recomendados para encontrar puntos de fallo.

Demasiadas referencias a la Vez

Subí el máximo: 9 imágenes de personaje/escena, 3 videos de movimiento de cámara diferentes. Escribí un prompt detallado explicando el rol de cada referencia.

Resultado: Mezcla de elementos aleatorios. El personaje de la imagen 3 apareció con la escena de la imagen 7. Los movimientos de cámara de los videos 1 y 2 se cruzaron. La IA no pudo rastrear 12 instrucciones simultáneas.

Límite práctico descubierto: 6-7 referencias totales producen resultados confiables. 8-9 referencias comienzan a mostrar confusión. ¿10-12 referencias? Técnicamente permitido, pero la calidad cae notablemente.

Referencia de video más larga de 15 segundos

Subí un video de referencia de 22 segundos mostrando movimientos de cámara complejos. El sistema lo aceptó durante la carga.

Resultado: El video generado solo copió los primeros 15 segundos de movimiento de cámara. Los últimos 7 segundos no se usaron en absoluto.

El límite oficial dice que los videos deben ser de menos de 15 segundos en total. La interfaz no bloquea cargas más largas, pero el modelo solo procesa los primeros 15 segundos de tus referencias de video combinadas.

Texto en pantalla

La documentación oficial dice "preservación de texto mejorada en escenarios de imagen a video". Probé con empaques de productos que mostraban logotipos de marcas.

Resultado: El texto pequeño (equivalente a menos de 24pt) se desenfoca o deforma. El texto grande (tamaño logotipo) permanece legible alrededor del 60% de las veces. Si tu video necesita texto en pantalla, agrégalo en postproducción; no confíes en el generador para preservarlo de las referencias de imagen.

Física compleja (agua, humo, fuego)

Probé con una escena de playa: olas rompiendo, efectos de rocío. El agua se movía, pero la física se veía mal. Las olas no rompían naturalmente, la espuma aparecía y desaparecía de manera inconsistente.

Comparado lado a lado con un video de playa de Sora 2 (tengo acceso limitado a Sora). La física del agua de Sora se veía notablemente más realista: formación de olas adecuada, comportamiento consistente de la espuma, refracción de luz natural.

La física de Seedance 2.0 funciona bien para la mayoría de las escenas. Pero si tu video se centra en simulaciones de fluidos o efectos de fuego, espera regenerar varias veces o aceptar un movimiento ligeramente antinatural.

Primeros Planos de Manos

La debilidad clásica de la IA. Generé un video mostrando manos escribiendo en un teclado. Las posiciones de los dedos eran... creativas. Físicamente imposibles, pero la IA lo intentó.

Los planos generales que muestran manos funcionan bien. Los planos medios están bien. ¿Primeros planos extremos donde los dedos hacen acciones precisas? Todavía se rompe con frecuencia.

Preguntas frecuentes sobre Seedance 2.0

¿Las referencias de video cuestan más créditos que las referencias de imagen?

Sí. El sistema me advirtió sobre esto después de mi cuarta generación usando referencias de video. En mis ejecuciones, generar dos videos de 15 segundos costó alrededor de 120 créditos. Si tienes un presupuesto de créditos limitado, usa referencias de video selectivamente, solo cuando el control de la cámara realmente importe.

¿Puedo usar los mismos archivos de referencia en múltiples generaciones?

Sí, y deberías. Una vez subidos, los archivos de referencia permanecen en la biblioteca de tu proyecto. Reutilicé las mismas 3 imágenes de personajes en 15 generaciones diferentes: la misma apariencia cada vez, sin volver a subir. Ahorra tiempo y mantiene la consistencia del personaje en toda una serie de videos.

¿Cómo sé qué referencia está usando la IA para qué?

Sé explícito en tu prompt. Los prompts ambiguos como "Usa @imagen1 y @video1" producen resultados impredecibles. Los prompts específicos como "@imagen1 cara del personaje, @video1 movimiento de cámara" funcionan el 90% de las veces. Cuando probé 20 generaciones con referencias vagas frente a 20 con instrucciones específicas, lo específico ganó 18/20 veces.

¿Puedo extender un video múltiples veces?

Sí. Encadené 4 extensiones (7s base + 6s + 10s + 15s = 38s total). La calidad se mantuvo consistente hasta la extensión 2. La extensión 3 mostró una pequeña desviación de color. La extensión 4 fue lo suficientemente notable como para usarla solo para vistas previas aproximadas, no para la entrega final. Límite práctico: 2-3 extensiones antes de que la calidad se degrade.

¿Funciona Seedance 2.0 con videos de Seedance 1.5 Pro?

Sí. Generé un video en Seedance 1.5 Pro, luego lo subí como referencia en 2.0 para extenderlo. Funcionó perfectamente, sin problemas de compatibilidad. Esto significa que puedes comenzar proyectos en 1.5 Pro ahora y continuarlos en 2.0 cuando se abra la API.

¿Cuál es la diferencia real entre los modos "Fotograma Inicio/Fin" y "Referencia Completa"?

Fotograma Inicio/Fin = animación simple de fotogramas clave. Sube 1-2 imágenes, la IA rellena el movimiento entre ellas. Bueno para movimientos básicos donde solo necesitas definir puntos de inicio y fin. Referencia Completa = control multimodal. Sube imágenes, videos, audio, haz referencia a todos con la sintaxis @. Bueno para producciones complejas donde necesitas un control preciso sobre múltiples elementos. Si solo usas 1-2 referencias de imagen, Fotograma Inicio/Fin es más rápido. Si necesitas más de 3 referencias o cualquier entrada de video/audio, usa Referencia Completa.

Conclusión

Seedance 2.0 resuelve el problema de "describir un movimiento de cámara en texto". Dejas de luchar con prompts como "plano dolly lento con ligera rotación" esperando que la IA entienda. Sube un video de referencia en su lugar.

La versión 1.5 se sentía aleatoria: obtenías lo que querías tal vez el 40% de las veces en el primer intento. La versión 2.0 acierta el 70-80% en el primer intento cuando te mantienes dentro de los límites (6 referencias o menos, movimientos de cámara simples a moderados, menos de 40s en total con extensiones).

El enfoque multimodal no son solo más características. Es control. Control real y confiable sobre lo que estás haciendo. Con herramientas como esta, todos somos directores ahora.

Si haces trabajo para clientes o creación de contenido con generadores de video de IA, vale la pena probar esto. El sistema @reference cambia el flujo de trabajo de "describir y esperar" a "mostrar y especificar".

¿Quieres empezar ahora? Seedance 1.5 Pro ya está en vivo. Utiliza animación de primer/último fotograma, pero los videos que crees en 1.5 funcionan como referencias en 2.0 después del lanzamiento. Comienza con animación básica de fotogramas clave ahora, actualiza al control multimodal completo después.

Sobre el Acceso y Disponibilidad: ByteDance planeó lanzar Seedance 2.0 el 24 de febrero de 2026, aunque el lanzamiento se pospuso varias veces a principios de este trimestre debido a los ajustes de infraestructura del servidor necesarios para manejar la carga de trabajo multimodal del modelo. El acceso actualmente permanece restringido. Esta reseña refleja pruebas prácticas desde el acceso de desarrollador mientras ByteDance escala hacia una disponibilidad pública más amplia.