Seedance 2.0 评测:多模态 AI 视频创作实测

你上传了一个参考视频,展示你想要的精确镜头运动。输入提示词"复制这个运动"。结果呢?角度完全错误,节奏也大相径庭,与你想要的效果完全不一样。听起来熟悉吗?

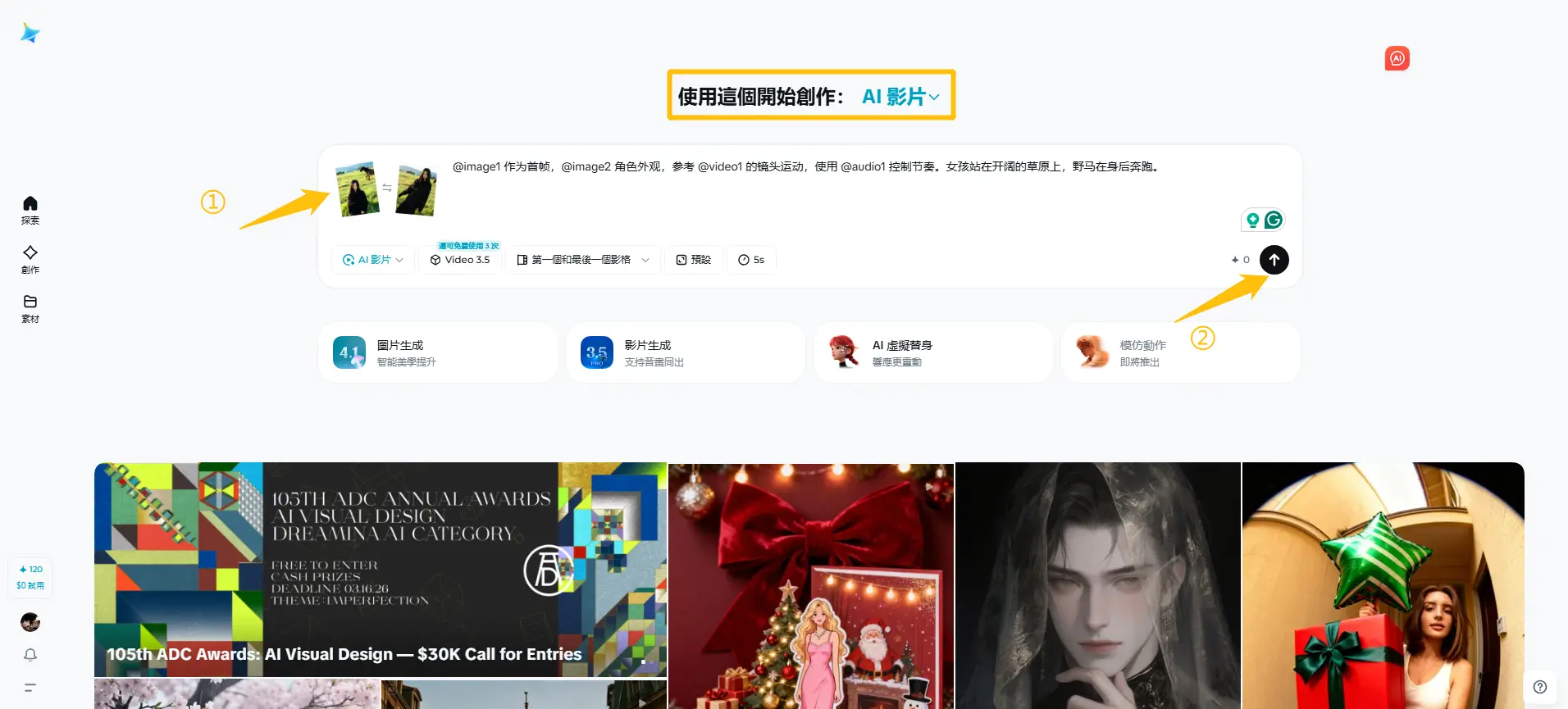

字节跳动推出的Seedance 2.0 试图改变这一切——这是他们核心的视频生成模型的最新升级版本。与 1.5 Pro(使用首尾帧关键帧)不同,2.0 版本可以同时接受图片、视频和音频——最多 12 个文件,具备完整的多模态参考控制。经过三天的测试,我可以确认它达到了预期效果。

它的与众不同之处在于:你可以在提示词中使用 @filename 语法直接引用每个文件。AI 会遵循你展示的内容,而不仅仅是你描述的内容。

进行了十多次生成测试。其中6次触及文件上限,还有两次导致系统崩溃。最终摸清了什么真正有效。如果你想现在就开始实验,Seedance 1.5 Pro 已经在 SeaArt AI 上公开可用,而 2.0 即将推出。

Seedance 2.0 限制总览

Seedance 2.0 硬性限制:

- 图片:每次生成最多 9 张

- 视频:最多 3 个文件,总时长不超过 15 秒

- 音频:最多 3 个 MP3 文件,总时长不超过 15 秒

- 文件总数:所有类型合计最多 12 个

- 输出时长:4-15 秒,可自选

- 内置音频:自动生成音效和音乐

Seedance 2.0 的独特之处

在深入讲解使用方法之前,先说说 2.0 版本与1.5 Pro的区别:

| 功能 | Seedance 1.5 Pro | Seedance 2.0 |

|---|---|---|

| 输入方式 | 仅支持首尾帧关键帧 | 多文件引用(图片+视频+音频) |

| 最大引用数 | 2 张图片(起始/结束帧) | 总计 12 个文件(9图+3视频+3音频) |

| 镜头控制 | 仅文字描述 | @引用视频实现精确镜头运动 |

| 音频生成 | 原生音视频同步 | 原生 + 引用音频控制 |

| 多镜头能力 | 单个连续镜头 | 一个提示词生成多镜头序列 |

| 角色一致性 | 中等(单镜头内) | 高(跨多镜头+扩展) |

| 分辨率 | 原生 1080p | 原生 1080p |

一个提示词实现多镜头叙事。你不需要手动拼接场景。写一个描述多个镜头的提示词,Seedance 2.0 就能生成一个连贯的序列,具备帧级精度。我用一个 3 场景的叙事进行了测试——镜头之间的转场保持流畅,角色外观始终一致。

原生音视频生成。音频和视频是同步生成的,而非分步处理。这意味着对话会自动与口型同步。我测试了英语和西班牙语的音素级唇形同步——两者都无需手动调整就能正常工作。

测试时迭代更快。在我的测试中,一个 15 秒的片段从头到尾通常需要 5-6 分钟。这仍然可以接受,但当你连续做 10 多次生成时就能感受到成本。最大的优势是参考文件减少了重试次数,所以你在同一个镜头上循环的时间更少。

1080p 电影级输出。原生 1080p 分辨率,镜头间运动保持一致。没有放大失真。画面足够干净,无需后期处理就能交付给客户。

多镜头连贯性对叙事和高冲击力动作场景最为重要。你可以用一个提示词生成完整的短片场景,而不是拼接 5 个单独的片段,然后祈祷角色保持一致。

Seedance 2.0 @引用系统:工作原理

Seedance 2.0 有两种输入模式:首尾帧模式和完整引用模式。

首尾帧模式:上传 1-2 张图片设置起始和结束关键帧。写一个文字提示词。完成。如果你现在正在使用 Seedance 1.5 Pro,这个工作流程会很熟悉——你定义开头和结尾,然后模型填充中间的运动。

完整引用模式:这是 2.0 的突破性功能。使用图片设置视觉风格,视频定义角色动作和镜头运动,音频控制节奏。在提示词中使用 @filename 语法引用每个文件。

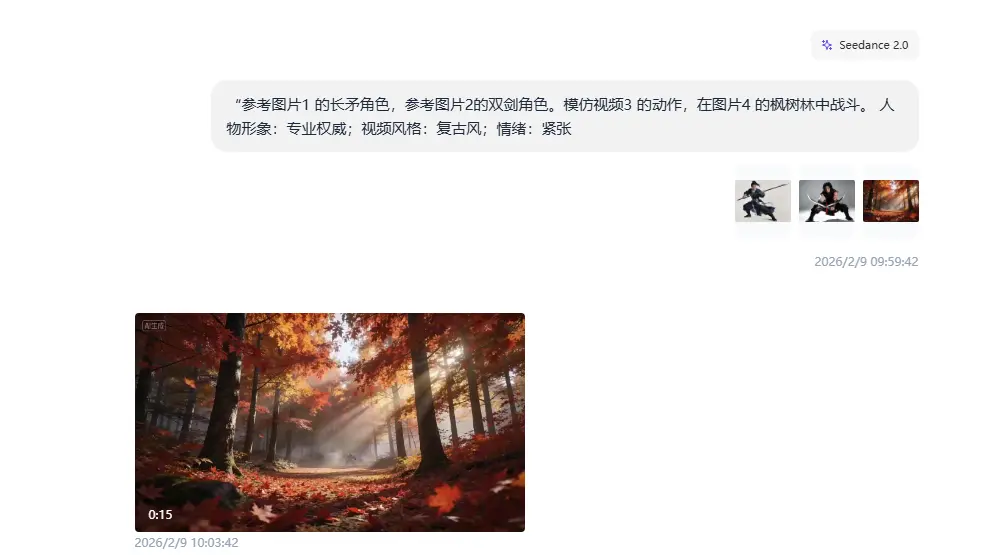

Seedance 2.0 多角色编排控制测试

这是我发现的控制复杂打斗的最简洁方法:使用图片锁定每个角色,然后用一个参考视频驱动时机和编排。

提示词结构示例:

"参考图片1的长矛角色,参考图片2的双剑角色,模仿视频3的动作,在图片4的枫叶林中战斗。人物形象:专业权威;视频风格:复古风;情绪:紧张"

系统会自动理解 @image1 作用是构图,@video1 用运动参考,@audio1 则是控制节奏。你不需要标注文件为"角色参考"或"镜头参考"——AI 会从上下文中推断。

重要提示:引用多个文件时,要明确说明每个文件的用途。像"使用 @video1 和 @video2"这样模糊的提示词,如果不解释它们的作用,会产生不一致的结果。我测试了 12 次——具体说明的指令有效率 11/12 次,模糊引用有效率 4/12 次。

有效的地方:两个角色都复制了参考视频中的战斗动作——特定的攻击模式、防御姿势、武器使用。枫叶林场景保持一致。角色服装在整个打斗过程中都与参考图片匹配。

不足之处:我的参考片段比输出短,所以最后几秒感觉是即兴发挥——模型填充了参考中没有的动作。

复杂度说明:3 张参考图片 + 1 个参考视频(总计 4 个文件)。

Seedance 2.0 音频同步剪辑测试

这个测试展示了音频参考如何主动控制音乐视频风格内容的配速和节奏,实现节拍驱动的剪辑。

提示词示例:

"参考 @video1 的格斗编排和镜头角度。角色1按照 @image1 呈现。角色2按照 @image2 呈现。战斗发生在 @image3 的日落沙漠中。使用 @audio1 驱动节奏——每次击打都落在强拍上。游戏风格呈现,夸张的冲击效果。镜头切换与音乐强度变化匹配。"

有效的地方:角色在整个过程中保持了他们风格化的游戏外观,拳打脚踢与音频节拍同步,影子跟随做的很好。日落沙漠背景保持视觉一致性。镜头切换感觉有意图,并与音乐能量匹配。

不足之处:动作之间的一些过渡帧出现了轻微变形。

我实际测试的内容

在探索 Seedance 2.0 时,我进行了大量测试。以下是一些代表性案例,展示了哪些方面可控,哪些方面开始猜测。

测试 1:跨复杂动作的角色一致性

我想看看 Seedance 2.0 能否在多场景情感叙事中保持角色外观。

我的提示词:

"男人 @image1 下班后走过走廊,疲惫,放慢脚步。在前门停下。面部特写,男人深吸一口气,调整情绪,隐藏负面情绪,变得放松。特写找钥匙,插入锁中。进入家中。他的女儿和宠物狗高兴地跑过来拥抱他。室内温暖。整个过程有自然对话。"

有效的地方:角色面部在 6 次场景变化中保持一致(走廊、门口、家中)。情感转变(疲惫、勉强微笑、真诚快乐)在面部表情中清晰展现。女儿和狗的角色在整个过程中保持外观。

生成时间:15 秒视频约 5-6 分钟

出乎意料的是:模型理解了"自然对话",并在我没有上传音频参考的情况下同步了口型动作。自动生成了家庭环境音效。

测试 2:多镜头咖啡店序列

这是那种你想要电影语言的场景,而不仅仅是"一个女人喝咖啡"。提示词必须起到导演的作用。

我的提示词:

"黄金时刻,一家温暖现代咖啡店的电影镜头序列。开场广角外景定场镜头,温暖的灯光;柔和的散景光透过大玻璃窗。切到特写:一位身着优雅休闲装的白人女士从左下角[门]进入,镜头跟随她轻推门进入。镜头以平滑的跟拍镜头移动,她穿过木地板走向窗户。她缓步走近一张桌子并坐下。过渡到中景特写:她拿起一个白色陶瓷咖啡杯,送到嘴边,安静地啜饮。柔和的窗户自然光照亮她的脸。暖色调,浅景深,电影感散景背景,流畅的镜头运动,16:9画幅。"

我学到的:当你明确镜头类型(广角外景、特写、中特写)和镜头行为(平滑跟踪)时,场景更有可能读起来像一个真实的序列,而不是一个长而飘浮的镜头。

可能偏移的地方:没有角色参考图片时,面部和服装细节可能在镜头之间略有变化。保持提示词紧凑,除非需要,否则避免添加额外角色。

测试 3:音频配速剪辑

当你没有参考视频时,音频仍然可以为模型提供结构。我测试了针对清晰节拍的快速剪辑。

我的提示词:

"使用 @audio1 控制配速和剪辑时机。@image1 = 舞者身份/服装;@image2 = 夜晚街道位置/照明。12秒快速剪辑蒙太奇,剪辑落在强拍上:0-4秒低角度脚步特写(鞋子+湿地面反射),4-8秒稳定居中中景镜头(一个干净的旋转动作),8-12秒广角镜头(结束+小群众反应)。复古电影感:35mm 胶片颗粒,微妙光晕,高对比度,霓虹灯+温暖街灯混合。保持舞者一致;无扭曲的手,无断肢,无镜头抖动。"

我学到的:对于强烈的 4/4 节拍,剪辑时机更接近重拍。对于更柔和或不规则的节奏,时机会漂移,蒙太奇感觉不那么有意图。

Seedance 2.0 擅长的实际用例

根据我的测试和模型的能力,以下是它解决实际制作问题的场景:

电商产品视频

产品演示需要一致的品牌、流畅的镜头运动和节拍同步的配速。上传你的产品照片作为图片参考,一个专业的镜头运动视频,以及背景音乐。Seedance 2.0 将它们组合成精致的 10-15 秒片段,随时可用于社交广告。

为什么有效:@引用系统让你精确控制品牌颜色、logo 位置和镜头角度。不再需要重新生成 20 次,希望 AI 正确猜测你的风格。

电影场景和电影级短片

如果你正在构建一个电影般的时刻,通常需要三样东西:一致的角色、可读的镜头语言和感觉有意图的配速。Seedance 2.0 在你明确写出镜头类型(广角、特写、过肩)并保持场景约束紧凑时表现强劲。

为什么重要:你可以从一个提示词生成连贯的迷你序列,而不是拼接单独的片段,并祈祷主角在每个镜头中看起来一样。

角色驱动的叙事内容

短片和系列内容需要跨多个镜头的角色一致性。我的"男人回家"测试证明了这一点——同一角色通过 6 个不同的镜头角度和照明条件。

制作价值:你可以在一次生成中获得多角度覆盖(广角镜头、特写、过肩)。无需分别拍摄,并希望在编辑期间一致性保持。

更好结果的专业技巧

经过 10 多次生成,这些技术持续改善了输出质量:

想快速上手通用工作流程,推荐阅读:轻松玩转SeaArt AI和 Nano Banana爆款玩法。

优化你的提示词

具体说明时间。"女人走 3 秒,停下,转身 2 秒"比"女人走路和转身"效果更好。当你明确说明时,AI 理解持续时间。

清楚描述镜头运动。"镜头向左平移同时略微变焦"比"有趣的镜头运动"好。尽可能引用现有镜头,而不是描述复杂的运动。

将复杂动作分解为阶段。"角色跑步(0-5秒),跳过障碍物(5-8秒),着陆并翻滚(8-12秒)"比"角色进行跑酷动作"产生更流畅的结果。

参考文件策略

使用 1-2 张图片保持角色一致性。超过 3 张角色图片会让模型混淆应该优先考虑哪个外观。坚持使用一个主角度和一个侧面照。

视频参考在 10 秒以下效果最好。15 秒的限制是技术性的,但 8-10 秒是实际的。更长的参考意味着 AI 有更多运动需要解释,可能会错过关键动作。

音频自动驱动配速。如果你的音频有清晰的节拍,你不需要在提示词中指定"镜头运动与音乐同步"。模型会检测节奏并相应对齐视觉效果。

何时使用扩展 vs 新生成

扩展时机:你有一个好的基础片段,想要继续动作。角色外观在 2-3 次扩展中保持良好(总计最多 40 秒)。

新生成时机:你需要完全不同的角度或场景。扩展最适合运动延续,而不是视角变化。

编辑现有片段时机:你想改变一个元素(更换角色、调整背景)而不重新生成所有内容。角色更换在测试期间每次迭代为我节省了 5-10 次尝试。

视频扩展:不只是生成,继续拍摄

扩展工作流程一开始让我困惑。当你写"扩展 @video1 10秒"时,你选择的生成长度应该与你要添加的新部分一致(10 秒)——而不是原始视频加扩展的总长度。

扩展提示词结构:

扩展 @video1 10 秒。[描述新 10 秒部分发生的事情]

然后设置:生成长度 = 10秒

我用与多镜头提示词相同的咖啡店设置测试了这一点。扩展的效果如下:

扩展提示词示例(继续故事):

"扩展 @video1 10 秒。她放下杯子,安静地呼气,然后站起来。她走到柜台付款,与咖啡师交谈几句,然后离开咖啡馆。以从街对面的广角镜头结束,她走进黄金时刻的光线中。"

- 基础视频:来自上面测试 2 的 15 秒咖啡店片段——她进入,穿过木地板,在窗边坐下,安静地啜饮

- 扩展:添加了 10 秒——她放下杯子,站起来,走到柜台付款,离开咖啡馆。最后从街对面的广角镜头,温暖的外部光线和柔和的背景散景

角色外观在所有三次扩展中保持良好,黄金时刻的照明大部分保持一致。偏移出现在小的服装细节上(扩展之间颜色略有变化)解决方法是:在每个扩展提示词中重新说明风格约束,即使感觉重复。

视频中角色更换

你可以通过上传参考图片并告诉模型替换一个人,同时保持所有动作和镜头角度,来更换现有视频中的角色。身体动作、舞台定位和背景元素会延续。照明会自动调整以匹配新角色。它的成本与新生成相同,但当你需要保留特定编排时,可以节省多次重试循环。

Seedance 2.0 失效的地方

我故意超出推荐限制来找出失败点。

一次引用太多

上传了最大数量:9 张角色/场景图片,3 个不同的镜头运动视频。写了详细的提示词解释每个引用的作用。

最终生成的内容杂乱无章,图片 3 中的角色出现在图片 7 的场景中。视频 1 和 2 的镜头运动交叉了。AI 无法跟踪 12 个同时指令。

发现的实际限制:6-7 个总引用产生可靠结果。8-9 个引用开始显示混乱。10-12 个引用?技术上允许,但质量明显下降。

视频参考超过 15 秒

上传了一个 22 秒的参考视频,展示复杂的镜头运动。系统在上传时接受了它。

结果:生成的视频只复制了前 15 秒的镜头运动。最后 7 秒根本没有使用。

官方限制说视频必须在 15 秒以下总计。界面不会阻止更长的上传,但模型只处理你组合视频参考的前 15 秒。

屏幕上的文字

官方文档说"在图片到视频场景中文本保留有所改进"。我用显示品牌 logo 的产品包装进行了测试。

结果:小文字(相当于 24pt 以下)模糊或变形。大文字(logo 大小)约 60% 的时间保持可读。如果你的视频需要屏幕文字,在后期添加——不要依赖生成器从图片参考中保留它。

复杂物理(水、烟、火)

用海滩场景测试——海浪拍打,喷雾效果。水在移动,但物理看起来不对。海浪没有自然破碎,泡沫不一致地出现和消失。

与 Sora 2 海滩视频并排比较(我有有限的 Sora 访问权限)。Sora 的水物理看起来明显更真实——适当的波浪形成,一致的泡沫行为,自然的光折射。

Seedance 2.0 的物理对大多数场景都很好。但如果你的视频专注于流体模拟或火效果,预计要重新生成几次或接受略微不自然的运动。

手部特写

经典的 AI 弱点。生成了一个显示手在键盘上打字的视频。手指的姿势颇有创意,但在物理上完全不可能实现。

显示手的广角镜头效果很好。中景镜头还可以。手指进行精确动作的极端特写?仍然经常失效。

如何访问 Seedance 2.0

Seedance 2.0 目前处于分阶段推出,访问权限有限。为 Seedance 2.0 做准备的最佳方式是通过 SeaArt AI,其中 Seedance 1.5 Pro 已经公开可用。

在 SeaArt AI 上开始

- 创建 SeaArt AI 账号

- 导航到视频生成部分

- 选择 Seedance 1.5 Pro

- 练习你的提示词和引用工作流程

为什么现在就用 1.5 Pro 开始:你在 Seedance 1.5 Pro 中创建的视频在 2.0 访问开放时可以作为参考。你现在可以建立参考片段库,然后稍后将它们用作 @video 引用。这意味着你的 1.5 Pro 工作不会浪费——它成为你的 2.0 工作流程的一部分。

Seedance 2.0 常见问题

视频参考比图片参考消耗更多积分吗?

是的。在我第四次使用视频参考生成后,系统警告了我这一点。在我的测试中,生成两个 15 秒视频花费了约 120 积分。如果你的积分预算有限,有选择地使用视频参考——只在镜头控制真正重要时使用。

我可以在多次生成中使用相同的参考文件吗?

可以,而且你应该这样做。上传后,参考文件会保留在你的项目库中。我在 15 次不同的生成中重复使用了相同的 3 张角色图片——每次外观相同,无需重新上传。节省时间并在整个视频系列中保持角色一致性。

我如何知道 AI 使用哪个参考做什么?

在提示词中明确说明。像"使用 @image1 和 @video1"这样模糊的提示词会产生不可预测的结果。像"@image1 角色面部,@video1 镜头运动"这样的具体提示词 90% 的时间有效。当我用模糊引用测试 20 次生成 vs 用具体指令测试 20 次时,具体的赢了 18/20 次。

我可以多次扩展视频吗?

可以。我链接了 4 次扩展(7秒基础 + 6秒 + 10秒 + 15秒 = 总计 38秒)。质量在扩展 2 之前保持一致。扩展 3 显示了轻微的颜色漂移。扩展 4 明显到我只会将其用于粗略预览,而不是最终交付。实际限制:质量下降前 2-3 次扩展。

Seedance 2.0 能与 Seedance 1.5 Pro 视频配合使用吗?

可以。在 Seedance 1.5 Pro 中生成视频,然后将其作为参考上传到 2.0 以扩展它。完美运行——没有兼容性问题。这意味着你现在可以在 1.5 Pro 中开始项目,并在 API 开放时在 2.0 中继续。

"首尾帧"和"完整引用"模式的实际区别是什么?

首尾帧 = 简单的关键帧动画。上传 1-2 张图片,AI 填充它们之间的运动。适合只需要定义起点和终点的基本运动。完整引用 = 多模态控制。上传图片、视频、音频,用 @语法引用它们所有。适合需要对多个元素进行精确控制的复杂制作。如果你只使用 1-2 张图片参考,首尾帧更快。如果你需要 3+ 个参考或任何视频/音频输入,使用完整引用。

结论

Seedance 2.0 解决了"用文字描述镜头运动"的问题。你不再需要与像"慢推轨镜头带轻微旋转"这样的提示词斗争,希望 AI 理解。直接上传参考视频。

1.5 版本感觉随机——第一次尝试你得到你想要的可能只有 40% 的时间。2.0 版本在你保持在限制内时(6 个或更少引用,简单到中等镜头运动,扩展总计 40 秒以下)第一次尝试达到 70-80%。

多模态方法不仅仅是更多功能。它是控制。对你正在制作的东西的实际、可靠的控制。有了这样的工具,人人都是导演。

如果你正在用 AI 视频生成器做客户工作或内容创作,这值得测试。@reference 系统将工作流程从"描述并祈祷"改变为"展示并指定"。

想现在就开始?Seedance 1.5 Pro 已经上线。它使用首尾帧动画,但你在 1.5 中创建的视频在推出后可以作为 2.0 的参考。现在开始使用基本关键帧动画,稍后升级到完整的多模态控制。

关于访问和可用性:字节跳动计划于 2026 年 2 月 24 日推出 Seedance 2.0,尽管由于需要服务器基础设施调整以处理模型的多模态工作负载,发布在本季度早些时候曾多次推迟。访问目前仍然受限。本评测反映了来自开发者访问的实际测试,字节跳动正在向更广泛的公众可用性扩展。