Seedance 2.0 完整使用指南:在SeaArt AI上玩轉最強AI影片模型

字節跳動(ByteDance)推出的 Seedance 2.0 自發布以來備受關注。憑藉多模態輸入、多鏡頭連貫性以及內建影片編輯功能,在 2026 年初的 AI 影片工具中脫穎而出。

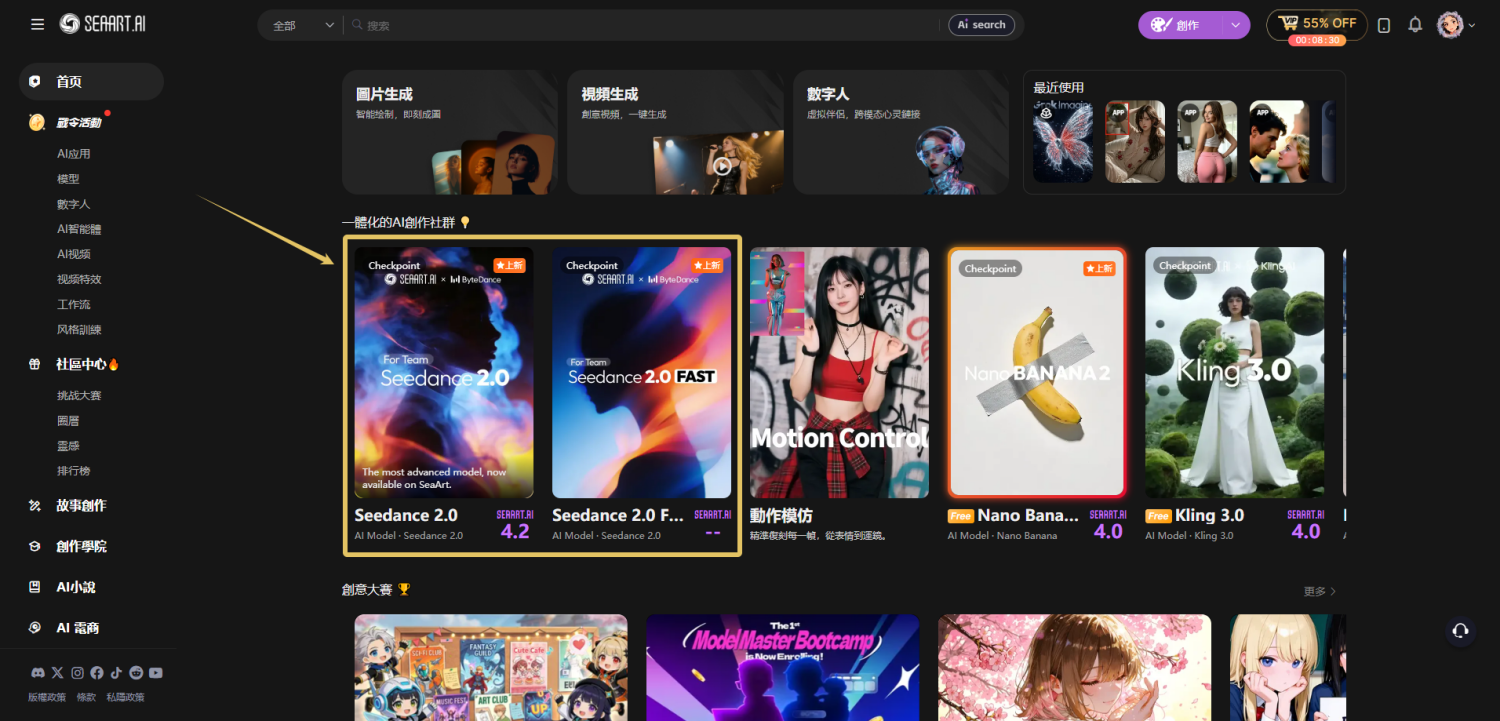

如今,Seedance 2.0 已正式登陸 SeaArt AI,完整功能現已開放,即刻即可體驗。

核心摘要: Seedance 2.0 是字節跳動最新的 AI 影片生成模型,現已上線 SeaArt AI。你可以上傳最多 12 個檔案(圖片、影片、音訊),在提示詞中透過 @ 標籤引用,生成每個鏡頭中角色保持一致的多鏡頭影片,音訊同樣自動對齊。

Seedance 2.0 有哪些新功能

Seedance 2.0 改變了你控制 AI 影片生成的方式。你可以自由組合文字、圖片、影片和音訊作為輸入,只需說明你的需求,其餘交由模型自動完成。

| 功能 | 說明 |

|---|---|

| 📸 參考圖片 | 精確還原構圖、角色細節與視覺風格 |

| 🎥 參考影片 | 複製運鏡語言、複雜動作編排與創意效果 |

| 🔗 無縫延伸 | 根據提示詞生成連續鏡頭,不只是「生成」,而是「持續拍攝」 |

| ✂️ 進階編輯 | 替換角色、移除元素,或在現有影片中加入新元素 |

參考系統的運作方式:使用 @檔案名稱 的語法,為每個上傳的檔案指定具體用途。例如:將 @image1 設為開場畫面,@video1 作為運鏡參考,@audio1 作為背景音樂。透過這種直接對應的方式,你可以精確掌控生成影片中的每一個元素。

單段提示詞生成多鏡頭序列

描述一段帶有時間分段的場景或敘事,模型就能生成貫穿整個序列的連續鏡頭。角色可以在不同鏡頭中經歷三種截然不同的視覺狀態(人類士兵、半機械人、完全機甲),臉部結構、服裝基底與身體比例始終保持固定。這背後是角色一致性系統在運作:RoPE 位置編碼在每次鏡頭切換之間持續追蹤角色身份,你不需要手動維護前後一致性,模型會自動處理。

影片續拍與無縫編輯

Seedance 2.0 支援四種編輯模式:向後延伸(繼續故事)、向前延伸(加入前情提要)、劇情改寫(更改敘事走向),以及局部調整(修改特定元素)。以下範例展示的是向前延伸功能,在主要場景之前加入背景脈絡。

原始影片:一個男人在街上與女人相撞,女方生氣,男方道歉,是一段簡單的七到八秒互動。

向前延伸提示詞:

結合 @video1,在開頭加入場景:主角在街上行走時接到電話。保持一致的視覺風格。

加入前情提要之後,敘事有了脈絡。搭配原本的碰撞場景,整個故事便有了清楚的動機與結果,形成一條完整的弧線。

如何在 SeaArt AI 上使用 Seedance 2.0

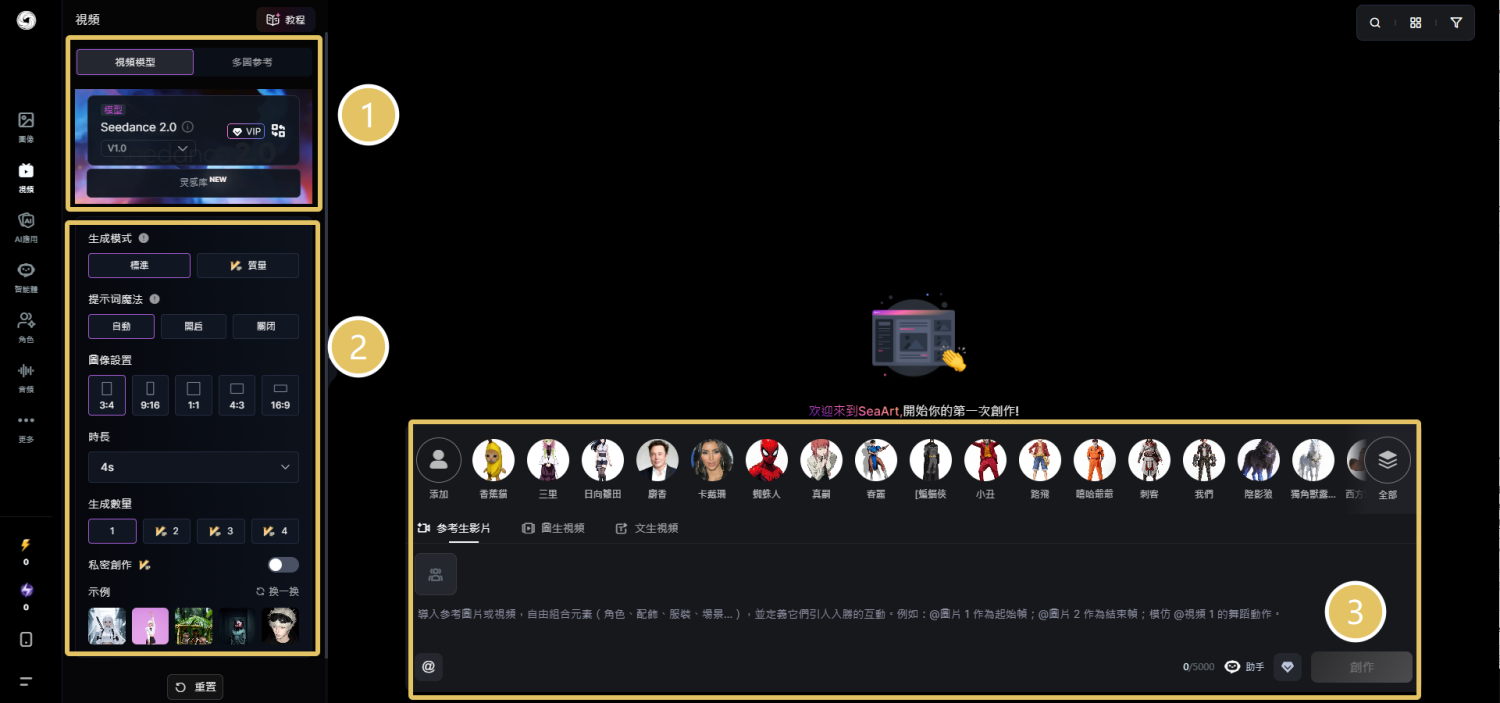

目前提供兩個模型:Seedance 2.0 與 Seedance 2.0 Fast。開啟任一模型後,依照以下三個步驟操作:

步驟一:選擇模式。提示詞輸入區提供三個分頁:Reference to Video(上傳圖片或影片,並使用 @ 標籤組合角色、道具與場景)、Image to Video(上傳一張圖片並描述動作),以及 Text to Video(僅輸入提示詞,無需上傳)。

步驟二:上傳素材並設定參數。在 Reference to Video 模式中,每個上傳的檔案會自動取得標籤(@Image 1、@Image 2、@Video 1),可在提示詞中直接引用。設定畫面比例(3:4、9:16、1:1、4:3、16:9)、時長(4 秒至 15 秒),以及生成模式(Standard 或 Quality)。

步驟三:撰寫提示詞並生成。描述動作、運鏡方向、情緒氛圍與音訊需求,在提示詞中以標籤引用上傳的檔案,點擊 Generate,完成後即可從結果頁面下載。

如何為 Seedance 2.0 撰寫提示詞

Seedance 2.0 對提示詞的遵循度明顯優於舊版,能夠依照具體指令執行,而非只是感受整體風格基調。儘管如此,提示詞的架構依然關鍵。如需 20 個以上涵蓋電影預告片、舞蹈影片、動作場景與產品廣告的即用提示詞範本,請參閱 Seedance 2.0 提示詞指南。

使用多個參考檔案時,請說明每個檔案的用途

上傳檔案時若沒有說明用途,模型只能自行猜測。請明確告訴它每個參考檔案對應控制的內容。

展示 image1 中的舞者在舞台上表演。使用 video1 中所示的舞蹈動作與編排。將場景設定在 image2 的錄音室環境中。將每個動作切換與 audio1 的節拍同步。電影風格,舞台暖光燈。

使用時間段落標記多鏡頭序列

以精確的時間範圍標記每個段落,模型會將其視為鏡頭邊界,在整個序列的鏡頭切換中維持連貫的連續性。

強烈的節奏音樂驅動蒙太奇,搭配快切、慢動作、微距與縮時攝影。音訊:節拍、低音脈衝、呼吸聲、環境音效,無對白。0 到 5 秒:快切蒙太奇,白色花朵在極端微距慢動作中綻放,翠綠極光在湖面上翩翩起舞並形成完美倒影,芭蕾舞者踮起腳尖在黑色舞台上旋轉的瞬間,蝴蝶翅膀鱗片在金光下閃爍,火山爆發熔岩向上迸射。5 到 10 秒:快切蒙太奇,座頭鯨在水下垂直俯衝,陽光穿透深藍色海洋,銀河在靜謐湖面上完美倒映,地平線上有孤獨身影,金黃時刻麥田在逆光中搖曳,溫暖散景,接著切至黑色畫面,以極簡白色文字顯示:SEEDANCE 2.0

使用電影攝影術語控制運鏡

Seedance 2.0 能精確回應標準電影攝影術語,以下列出的術語均可穩定使用:

| 術語 | 說明 |

|---|---|

| Push-in | 鏡頭朝主體方向前進推近 |

| Pull-out / pull-back | 鏡頭向後移動,展現更廣的背景 |

| Orbit shot | 鏡頭繞固定主體環繞旋轉 |

| Tracking shot | 鏡頭跟隨移動中的主體 |

| Dutch angle | 鏡頭傾斜,製造緊張感 |

| Shallow depth of field | 主體清晰,背景模糊 |

| Handheld feel | 輕微的鏡頭晃動,畫面更有真實感,少了刻意精緻的感覺 |

Seedance 2.0 最佳提示詞範例

以下是能展示 Seedance 2.0 穩定執行能力的真實提示詞,每則範例各針對一項特定功能。

1. 科幻角色展示

使用 @image1 作為臉部參考。保持臉部完全一致,不得改變五官或表情。風格:BLACK SUN 科幻美學,暗系攝影,生化機械設計,淺景深。角色:黑色生化機械外套加黑色內裡,海浪捲髮,裸露頸部,女性特徵,腰線,高級金屬科幻燈光,面料上有精細技術紋樣。環境:戶外廢土,灰藍色天空,有風。運鏡:固定中景,30 度側角,緩慢向上平移並推進,不剪輯連續拍攝,平滑慢動作品質。變身:深紅色微光加暗霓虹發光文字,身體輕微變換姿勢。效果:暗色生化物質加黑色幾何發光圖案,金屬質感,動態生長,細微粒子,紅色高光。結尾:定格最終姿勢 3 秒,酷感質感收尾。

需要留意的地方:觀察臉部在整個片段中與參考圖片的一致性。早期模型不是在片段中途出現臉部偏移,就是產生生硬的姿勢切換。這個提示詞的結構,正是針對這兩個問題所設計的。

2. 傳統戲曲表演

使用 @image1 作為表演者的參考。傳統舞台,昏暗燈光。鏡頭從特寫開始,以慢動作緩慢環繞她旋轉,展現服裝細節。她保持靜止,雙眼凝視鏡頭。快速切換至側面視角,正常速度。她以經典手勢抬起雙臂,袖子優雅飄動。鏡頭緩慢推進,她轉向鏡頭,舞台燈光下飾品閃閃發光。切換至極致慢動作,廣角鏡頭。她向兩側伸展雙臂,袖子在空中飄動,絲綢掠過鏡頭前方。暖色舞台燈光,電影風格。

這個提示詞測試了多速切換(慢動作到正常速度再到極致慢動作)與鏡頭角度切換。模型能在正確時機生成每個速度變化,無需手動剪輯。

3. 動作追逐場景

使用 @image1 作為開場畫面。鏡頭跟隨一名穿著黑色服裝的男子高速奔跑,急迫地逃跑。一群警察在後方追趕。鏡頭切換至側面跟拍,與奔跑者保持同步。在慌亂中,他撞上路邊的水果攤,攤上的水果四散飛落。他掙扎著站起來繼續奔跑。背景加入驚慌的群眾反應與警笛聲。

這個提示詞展示了自動鏡頭角度切換(正面視角到側面跟拍)以及散落物品的物理模擬效果。在提示詞中指定鏡頭切換,模型無需另行下達剪輯指令即可執行。

Seedance 2.0:告別手動剪接的時代

早期 AI 影片模型最大的問題不在於畫質,而在於結構。單獨一個 5 秒的片段看起來還不錯,但要把有頭有尾的完整場景組合起來,你就得手動拼接幾十個片段、自己排鏡頭清單、逐一同步轉場。AI 只負責生成素材,其他全部得靠你自己來。

Seedance 2.0 完全改變了這個局面。描述一段敘事(一個角色、一個情境、一連串事件),模型就能生成角色前後一致、光效相互呼應、鏡頭銜接流暢的完整序列。過去你是 AI 的後製剪輯師,現在 AI 成了你的執行導演。你只需要把故事說清楚,拍攝的部分交由模型完成。

音訊也是同樣的邏輯。對白、環境音與音效跟影片一起同步生成,自動對齊畫面動作,不需要另行後製。對大多數短影音內容來說,輸出結果已相當接近最終成品。

💡 補充說明:臉部參考最好使用清晰的正面人像,側面照或低解析度圖片容易在鏡頭間出現偏移。複雜的物理特寫(液體、布料、精細物件的互動),效果雖優於早期模型,但在未經確認的情況下仍未達到商業製作的水準。這類鏡頭建議先用 Fast 版本測試。

常見問題

在 SeaArt AI 上使用 Seedance 2.0 需要付費帳號嗎?

Seedance 2.0 採用點數制。如果有穩定的使用需求,付費方案提供的每月點數與優先處理資格,足以支撐實際使用需求。生成量若超出幾段測試影片,付費方案相當值得考慮。

SeaArt AI 上的 Fast 版本是什麼?是不同的模型嗎?

兩者底層模型相同,SeaArt AI 的 Fast 設定生成速度更快,消耗點數也較少,細節品質稍低但差距有限。適合拿來測試想法、確認結構,等準備輸出正式成品時再切換到標準版本。

我可以上傳現有影片並編輯特定部分嗎?

可以。在提示詞中以 @video1 引用影片,並說明你想改動的地方:替換角色、修改動作,或調整特定段落。模型會盡可能讓其他部分保持不變,但實際效果會因你想保留的原始內容多寡而有所差異。建議先用 Fast 版本測試。

Seedance 2.0 的多鏡頭連貫性實際上是如何運作的?

ByteDance 採用的是原生多模態架構,不是訓練完成後才把音訊與影片處理模組拼在一起。模型同時使用了 RoPE 位置編碼,這個技術最初是為了讓長文本語言模型維持上下文連貫性而設計,如今被用於在鏡頭切換之間維持語義連續性。這也使得一段提示詞就能生成長達 15 秒的多鏡頭序列,而且角色在第 1 個和第 6 個鏡頭裡看起來完全一樣。

一次生成中可以引用多少個檔案?

最多 12 個:9 張圖片、3 段影片和 3 個音訊。從實際操作的角度來看,將參考檔案控制在 7 個以下,結果較為穩定可預測。一旦超過這個數量,模型可能會自行降低部分輸入的優先度,且不會主動說明是哪些被忽略了。

Seedance 2.0 可以用於商業專案嗎?

請先查閱 SeaArt AI 目前的服務條款,確認商業使用的授權範圍。AI 生成影片的授權規定因版本而異,且可能隨模型更新有所調整。SeaArt AI 的一般商業條款同樣適用,建議在正式發布前確認清楚。

結語

回想五年前,拍攝一支廣告往往意味著高昂的成本:攝影棚、燈光團隊、演員、器材租賃缺一不可。一場突如其來的降雨,甚至可能讓拍攝計畫延誤整整一週。這曾是行業的常態,只有預算充足的團隊才能負擔。

而如今,這種差距正在迅速縮小。一個好的創意,加上一條清晰的提示詞,就有機會實現過去只有中等製作預算才能達到的效果。Seedance 2.0 的實測正是對這一變化的驗證:從動作編排到電影級鏡頭序列,再到音畫同步剪輯,幾乎都可以在同一平台上一站式完成。

模型無法取代你的創意判斷,但可以精準地執行你的想法。最終效果取決於你想做什麼,以及你能將它描述得多清晰,這一點始終沒有改變。

Seedance 2.0 現已在 SeaArt AI 上線,現在就開始你的 AI 創作之旅吧!