Seedance 2.0 en SeaArt AI: cómo crear videos con IA paso a paso

Seedance 2.0 ha generado un enorme interés desde su anuncio por parte de ByteDance. Gracias a su enfoque multimodal, la coherencia entre múltiples escenas y sus capacidades de edición de video integradas, se posiciona en una categoría diferente frente a la mayoría de herramientas de video con IA disponibles a inicios de 2026.

Ahora, el modelo SOTA de generación de video de ByteDance ya está oficialmente disponible en SeaArt AI, listo para que cualquier usuario pueda aprovechar todo su potencial.

En esta página descubrirás qué puede hacer realmente Seedance 2.0, cómo acceder a él dentro de SeaArt AI y qué estructuras de prompt funcionan mejor en la práctica.

🚀 Resumen rápido: Seedance 2.0 es el modelo más reciente de generación de video de ByteDance y ya está disponible en SeaArt AI. Permite subir hasta 12 archivos (imágenes, videos y audio), integrarlos en el prompt y generar videos con múltiples escenas manteniendo la coherencia del personaje en todos los cortes. Además, el audio se sincroniza automáticamente con el contenido visual.

Qué hay de nuevo en Seedance 2.0

Seedance 2.0 cambia la forma de crear videos con IA. Puedes usar cualquier combinación de texto, imágenes, videos y audio como entrada. Solo tienes que indicar lo que necesitas y el modelo se encarga del resto

| Función | Qué puedes hacer |

|---|---|

| 📸 Imágenes de referencia | Reproduce con precisión la composición, los detalles del personaje y el estilo visual |

| 🎥 Videos de referencia | Copia el lenguaje de cámara, coreografías de acción complejas y efectos creativos |

| 🔗 Extensión fluida | Genera tomas continuas siguiendo tus prompts; no solo "genera", sino "sigue grabando" |

| ✂️ Edición avanzada | Sustituye personajes, elimina elementos o añade otros nuevos en videos existentes |

Cómo funciona el sistema de referencias

Usa la sintaxis @nombredearchivo para asignar un papel concreto a cada archivo subido. Por ejemplo, @image1 como plano de apertura, @video1 como referencia del movimiento de cámara y @audio1 como música de fondo. Esta conexión directa te da un control preciso sobre cada elemento del video generado.

Secuencias de varias tomas a partir de un solo prompt

Describe una historia con bloques de tiempo y el modelo generará tomas conectadas a lo largo de toda la secuencia. El personaje del ejemplo pasa por tres estados visuales distintos, soldado humano, ciborg parcial y meca completo, en tomas separadas, pero los rasgos faciales, el vestuario base y las proporciones corporales se mantienen fijas. Ahí entra en juego el sistema de consistencia de personajes: la codificación posicional ROPE rastrea la identidad a través de los cortes, así que no tienes que gestionar la consistencia manualmente entre generaciones. El modelo se encarga automáticamente.

Extensión de videos sin cortes bruscos con edición fluida y natural

Seedance 2.0 admite cuatro modos de edición: extensión hacia atrás, para continuar la historia; extensión hacia adelante, para añadir una escena previa; reescritura de trama, para cambiar la narrativa; y ajustes locales, para modificar elementos concretos. El ejemplo siguiente muestra una extensión hacia adelante, añadiendo contexto antes de la escena principal.

Video original: Un hombre choca con una mujer en la calle. Ella se enfada y él se disculpa. Una interacción simple de 7 a 8 segundos.

Prompt de extensión hacia adelante:

Combina con @video1 para añadir la escena inicial: el personaje principal recibe una llamada telefónica mientras camina por la calle. Mantén un estilo visual coherente.

La escena previa añade contexto narrativo. Al combinarla con la escena original del choque, obtienes un arco completo que muestra motivación y consecuencia.

Cómo usar Seedance 2.0 en SeaArt AI

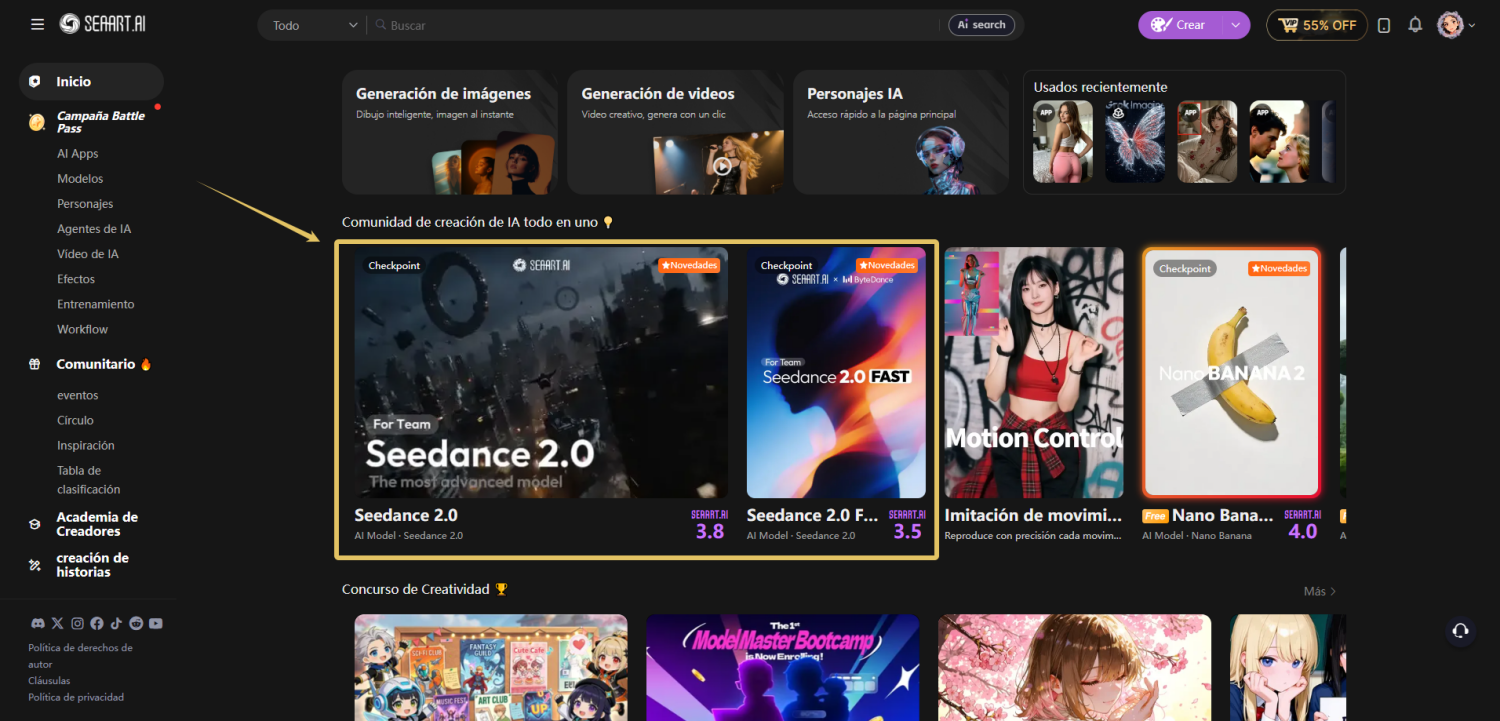

Hay dos modelos disponibles: Seedance 2.0 y Seedance 2.0 Fast. Abre cualquiera de los dos y sigue estos tres pasos:

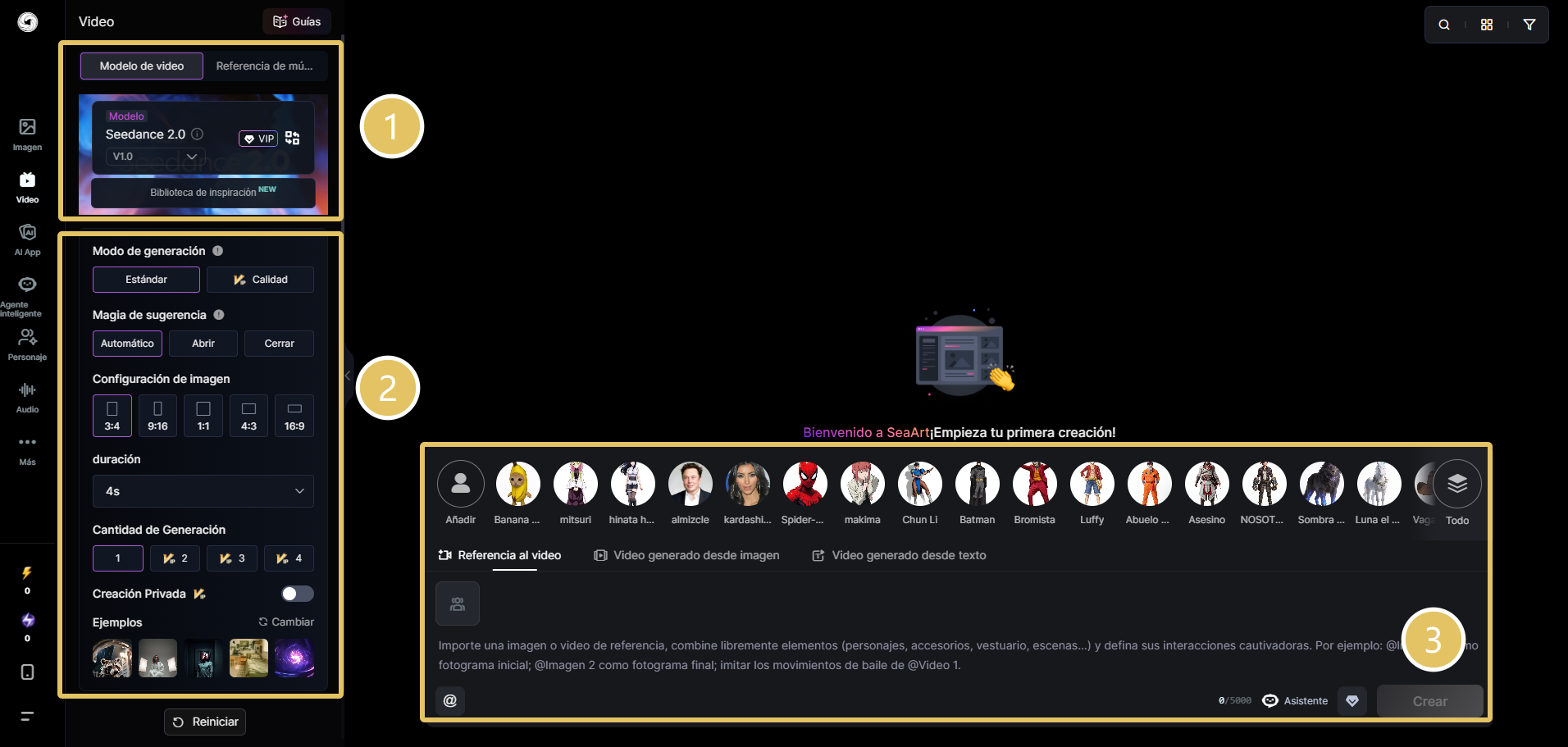

Paso 1. Elige el modo.

El área de prompt tiene tres pestañas: Reference to Video, para subir imágenes o videos y usar etiquetas @ para combinar personajes, objetos y escenas; Image to Video, para subir una imagen y describir el movimiento; o Text to Video, donde solo necesitas el prompt, sin subir archivos.

Paso 2. Sube tus recursos y configura los parámetros

En el modo Reference to Video, cada archivo subido recibe una etiqueta automáticamente, como @Image 1, @Image 2 o @Video 1, para usarla en el prompt. Ajusta la relación de aspecto, 3:4, 9:16, 1:1, 4:3 o 16:9; la duración, de 4 a 15 segundos; y el modo de generación, Standard o Quality.

Paso 3. Escribe tu prompt y genera

Describe el movimiento, la dirección de cámara, el ambiente y el sonido. Cuando sea necesario, referencia los archivos subidos mediante sus etiquetas. Haz clic en "Generar" y descarga el resultado desde la vista final cuando esté listo.

Cómo escribir prompts efectivos para Seedance 2.0

El nivel de fidelidad al prompt en Seedance 2.0 es claramente mejor que en versiones anteriores. Sigue instrucciones concretas, no solo el tono general. Aun así, la estructura del prompt sigue siendo clave. Si quieres más de 20 plantillas listas para copiar sobre tráilers cinematográficos, videos de baile, escenas de acción y anuncios de producto, consulta la guía de prompts de Seedance 2.0.

Si usas varias referencias, especifica el papel de cada archivo

Si subes un archivo sin contexto, el modelo tiene que adivinar su función. Dile con exactitud qué controla cada referencia.

Muestra a la bailarina de image1 actuando en el escenario. Usa la coreografía y los movimientos que aparecen en video1. Sitúa la escena en el entorno de estudio de image2. Sincroniza cada transición de movimiento con el ritmo de audio1. Estilo cinematográfico, iluminación cálida de escenario.

Usa bloques de tiempo para secuencias de varias tomas

Etiqueta cada segmento con rangos de tiempo exactos. El modelo los interpreta como límites entre tomas y genera escenas conectadas con continuidad consistente entre cortes.

Montaje impulsado por música de ritmo fuerte con cortes rápidos, cámara lenta, macro y time-lapse. Audio: golpes rítmicos, pulsos de bajo, respiración y sonidos ambientales únicamente, sin diálogo. 0-5s: Montaje de cortes rápidos, flor blanca abriéndose en cámara lenta macro extrema, aurora verde danzando sobre un lago con reflejo perfecto, bailarina de ballet en punta girando a media vuelta sobre un escenario negro, escamas de ala de mariposa brillando bajo luz dorada, erupción volcánica con lava elevándose violentamente. 5-10s: Montaje de cortes rápidos, ballena jorobada descendiendo en vertical bajo el agua con rayos de sol atravesando el océano azul profundo, galaxia de la Vía Láctea reflejada perfectamente en un lago inmóvil con una figura solitaria en el horizonte, trigo de la hora dorada balanceándose a contraluz con bokeh cálido, luego corte a pantalla negra con texto blanco minimalista centrado: SEEDANCE 2.0

Usa lenguaje cinematográfico para controlar la cámara

Seedance 2.0 responde con precisión a la terminología estándar del cine. Estos términos funcionan de forma fiable:

| Término | Qué hace |

|---|---|

| Push-in | La cámara avanza hacia el sujeto |

| Pull-out / pull-back | La cámara retrocede y revela un contexto más amplio |

| Orbit shot | La cámara gira alrededor de un sujeto fijo |

| Tracking shot | La cámara sigue al sujeto en movimiento |

| Dutch angle | La cámara se inclina sobre su eje y crea tensión |

| Shallow depth of field | El sujeto queda nítido y el fondo desenfocado |

| Handheld feel | Ligero movimiento de cámara, menos pulido y más realista |

Los mejores ejemplos de prompts para Seedance 2.0

Estos son prompts reales que muestran lo que Seedance 2.0 ejecuta con solidez. Cada uno pone a prueba una capacidad específica.

1. Muestra de personaje de ciencia ficción

Usa @image1 como referencia facial. Mantén el rostro completamente consistente, no alteres los rasgos ni la expresión. Estilo: estética de ciencia ficción BLACK SUN, fotografía oscura, diseño biomecánico, poca profundidad de campo. Personaje: abrigo biomecánico negro con forro negro, rizos como olas del mar, cuello expuesto, rasgos femeninos, cintura, iluminación metálica de estilo sci-fi avanzada, patrones técnicos intrincados en la tela. Entorno: páramo exterior, cielo gris azulado, viento. Cámara: plano medio fijo, ángulo lateral de 30 grados, paneo ascendente lento y acercamiento gradual, toma continua sin cortes, calidad de cámara lenta fluida. Transformación: microluz roja intensa y texto luminoso de neón oscuro, el cuerpo cambia ligeramente de pose. Efectos: biomateria oscura y patrones geométricos negros brillantes, textura metálica, efecto de expansión orgánica, partículas sutiles, reflejos rojos. Final: mantén la pose final durante 3 segundos, acabado con textura fría.

Nota: la consistencia del rostro en todos los fotogramas a partir de la imagen de referencia. Los modelos anteriores solían desviarse en los rasgos faciales a mitad del clip o producir transiciones de pose poco naturales. Este prompt está estructurado para evitar ambos problemas.

2. Representación de ópera tradicional

Usa @image1 como referencia para la intérprete. Escenario tradicional, iluminación tenue. La cámara comienza con un primer plano y gira lentamente a su alrededor en cámara lenta, revelando los detalles del vestuario. Ella permanece inmóvil, con la mirada fija en la cámara. Corte rápido a vista lateral, velocidad normal. Levanta los brazos con un gesto clásico, mientras las mangas fluyen con elegancia. La cámara avanza lentamente sobre rieles mientras ella gira hacia la cámara, con los adornos brillando bajo las luces del escenario. Cambio a cámara súper lenta, plano general. Extiende ambos brazos hacia fuera, las mangas ondean en el aire y la seda fluida roza el objetivo de la cámara. Iluminación cálida de escenario, estilo cinematográfico.

Este ejemplo pone a prueba los cambios de velocidad, de cámara lenta a velocidad normal y luego a cámara súper lenta, así como los cortes entre ángulos de cámara. El modelo genera cada cambio en el momento preciso sin necesidad de edición manual.

3. Secuencia de persecución de acción

Usa @image1 como plano de apertura. La cámara sigue a un hombre vestido de negro que corre a gran velocidad mientras huye con urgencia. Un grupo de policías lo persigue por detrás. La cámara cambia a un plano de seguimiento lateral, manteniendo el ritmo del corredor. En medio del pánico, choca contra un puesto de frutas junto a la carretera y la mercancía sale despedida por todas partes. Se levanta como puede y sigue corriendo. Fondo: reacciones de pánico de la multitud y sonido de sirenas policiales.

Este prompt demuestra el cambio automático de ángulo de cámara, de vista frontal a seguimiento lateral, y también la física de los objetos que salen despedidos. Si especificas el cambio de cámara en el prompt, el modelo lo ejecuta sin que tengas que indicar un corte aparte.

Seedance 2.0: adiós a la era del montaje manual de tomas

El mayor problema de los modelos de video con IA anteriores no era la calidad, sino la estructura. Podías generar un clip de 5 segundos que se veía bien por sí solo. Pero si querías construir una escena con principio, desarrollo y final, tenías que unir manualmente docenas de clips, escribir tu propia lista de planos y sincronizar las transiciones a mano. La IA generaba el metraje. Tú hacías todo lo demás.

Seedance 2.0 invierte esa lógica. Describes una narrativa, un personaje, una situación, una secuencia de acontecimientos, y el modelo genera tomas conectadas con personajes consistentes, iluminación alineada y transiciones coherentes en toda la secuencia. Antes tú eras el editor de posproducción de la IA. Ahora la IA ejecuta como si fuera tu director. Tu trabajo es contar la historia con claridad. El modelo se encarga de decidir cómo grabarla.

El audio funciona igual. El diálogo, el sonido ambiente y los efectos sonoros se generan junto con el video y quedan alineados con la acción, no añadidos después en una segunda fase. Para la mayoría del contenido corto, lo que obtienes ya se acerca bastante a un corte final.

💡 Nota: las referencias faciales funcionan mejor con retratos limpios y frontales; los perfiles laterales y las imágenes de baja resolución tienden a desviarse entre fotogramas. Y para primeros planos con física compleja, como líquidos, telas o interacciones detalladas entre objetos, el resultado es mejor que en modelos anteriores, pero todavía no está listo para producción sin revisión. Conviene probar primero ese tipo de tomas con la versión Fast.

Preguntas frecuentes

¿Necesito una cuenta de pago para usar Seedance 2.0 en SeaArt AI?

Seedance 2.0 funciona con créditos. Para un uso habitual, un plan de pago te da suficiente margen para trabajar de verdad con el modelo, con más créditos mensuales y cola prioritaria. Merece la pena si vas a generar algo más que unos pocos clips de prueba.

¿Qué es la versión Fast en SeaArt AI? ¿Es un modelo diferente?

Funciona sobre el mismo modelo base. SeaArt AI ofrece una configuración Fast que genera más rápido y cuesta menos créditos. La calidad es parecida, aunque algo inferior en el detalle fino. Úsala para probar ideas y definir la estructura, y cambia a la versión estándar cuando estés listo para el resultado final.

¿Puedo subir un video existente y editar partes concretas?

Sí. Haz referencia a tu video como @video1 dentro del prompt y describe qué quieres cambiar: sustituir un personaje, modificar una acción o ajustar un segmento. El modelo intentará mantener todo lo demás consistente. Los resultados varían según cuánto quieras preservar del original, así que conviene probar primero con el modelo Fast.

¿Cómo funciona realmente la coherencia de múltiples tomas en Seedance 2.0?

ByteDance construyó una arquitectura multimodal nativa, en lugar de unir audio y video después del entrenamiento. El modelo también aplica codificación posicional ROPE, desarrollada originalmente para mantener el contexto en modelos de lenguaje de texto largo, para conservar la continuidad semántica entre cortes de cámara. Eso permite que un solo prompt genere una secuencia de 15 segundos con varias tomas donde el personaje se ve igual en la toma 1 y en la toma 6.

¿Cuántos archivos puedo usar como referencia en una sola generación?

Hasta 12 en total: 9 imágenes, 3 videos y 3 pistas de audio. En la práctica, mantener el total por debajo de 7 suele dar resultados más predecibles. A partir de ahí, el modelo tiende a restar prioridad a algunas entradas sin indicar claramente cuáles.

¿Puedo usar Seedance 2.0 en proyectos comerciales?

Consulta las condiciones actuales de servicio de SeaArt AI para verificar los derechos de uso comercial. Las licencias del video generado con IA pueden variar y cambiar con las actualizaciones del modelo. Se aplican las condiciones comerciales generales de SeaArt AI, pero conviene comprobarlo antes de publicar.

Conclusión

Piensa en lo que implicaba producir un anuncio hace apenas cinco años: estudio de grabación, equipo de iluminación, actores, alquiler de equipos… Un simple retraso por lluvia podía desajustar toda la planificación de la semana. Ese era el punto de partida, y solo estaba al alcance de empresas con presupuestos sólidos.

Hoy, esa distancia se ha reducido de forma drástica. Una buena idea y un prompt bien definido pueden llevarte más lejos de lo que antes lograba un presupuesto de producción medio. Esta reseña de Seedance 2.0 pone a prueba precisamente ese límite: coreografías de combate, secuencias cinematográficas y transiciones perfectamente sincronizadas con el audio, todo generado dentro de la plataforma.

El modelo no puede sustituir tu criterio creativo, pero sí ejecutar tus ideas con precisión. El resultado final depende de lo que quieras crear y de lo claro que seas al describirlo. Eso no ha cambiado.

Seedance 2.0 ya está disponible en SeaArt AI. ¡Empieza a crear tu primer video con IA hoy!