Seedance 2.0をSeaArt AIで使える!最先端動画モデルの使い方完全ガイド

Seedance 2.0は、ByteDanceが発表した時点からかなり注目を集めていました。マルチモーダル入力、複数ショットの一貫性、動画編集機能を一体化したことで、2026年初頭に存在する多くのAI動画ツールとは明確に異なるカテゴリに入る存在です。

ByteDanceの現時点でのSOTA動画モデルが、SeaArt AIに正式ランディングしました。フル機能、今すぐ使えます。

この記事では、実際の機能の中身、SeaArt AIでのアクセス方法、そして結果につながる実践的なプロンプト構成を整理します。

📚 ポイント

Seedance 2.0はByteDanceの最新動画生成モデルで、SeaArt AIで使えます。最大12ファイル(画像・動画・音声)をアップロードして、プロンプトで「@」を使って指定することで、全カットを通じてキャラクターの一貫性を保ったマルチショット動画を生成できます。音声の同期にも対応しています。

Seedance 2.0の新機能

Seedance 2.0は、AI動画生成のコントロール方法を変えました。テキスト、画像、動画、音声を任意の組み合わせで入力できます。必要なものを指定すれば、あとはモデルが処理します。

| 機能 | 何ができるか |

| 📸 参照画像 | 構図、キャラクターの細部、ビジュアルスタイルを精密に再現 |

| 🎥 参照動画 | カメラの動き、複雑なアクション振り付け、クリエイティブエフェクトを写す |

| 🔗 シームレス延長 | プロンプトに沿って連続ショットを生成。「生成して終わり」ではなく「撮り続ける」発想 |

| ✂️ 高度な編集 | 既存動画でのキャラクター差し替え、要素の削除・追加 |

参照システムの仕組み

アップロードした各ファイルに @ファイル名 の構文で役割を割り当てます。たとえば @image1 をオープニングフレーム、@video1 をカメラワーク参照、@audio1 をBGMとして指定するイメージです。この直接的な紐づけにより、生成動画の各要素をコントロールしやすくなります。

1回のプロンプトでマルチショットを作る

タイミングブロックを使って物語の流れを書いていくと、モデルはシーケンス全体をまたいだ連続ショットを生成します。これがキャラクター一貫性システムの働きです。ROPEポジショナルエンコーディングがカット間をまたいでカット間でキャラクターの情報を保持するので、カットをまたいだ一貫性を手作業で管理する必要はありません。モデルが保持します。

動画を延長する:シームレス編集の考え方

Seedance 2.0は4つの編集モードに対応しています。後方延長(物語の続き)、前方延長(前日譚の追加)、プロット書き換え(ストーリーを変える)、ローカル調整(特定の要素だけを修正)です。以下の例は前方延長です。メインシーンの前に状況説明を加えていく方法です。

元の動画:

前方向への延長プロンプト例:

Combine with @video1 to add the opening scene: main character receives a phone call while walking on the street. Maintain consistent visual style.

@video1 と組み合わせて、冒頭シーンを追加する:主人公が街を歩きながら電話を受ける。ビジュアルのスタイルは一貫させる。

前日譚を加えることで、物語に文脈が生まれます。元の衝突シーンと組み合わせると、動機と結果がつながった一連のストーリーとして見せられます。

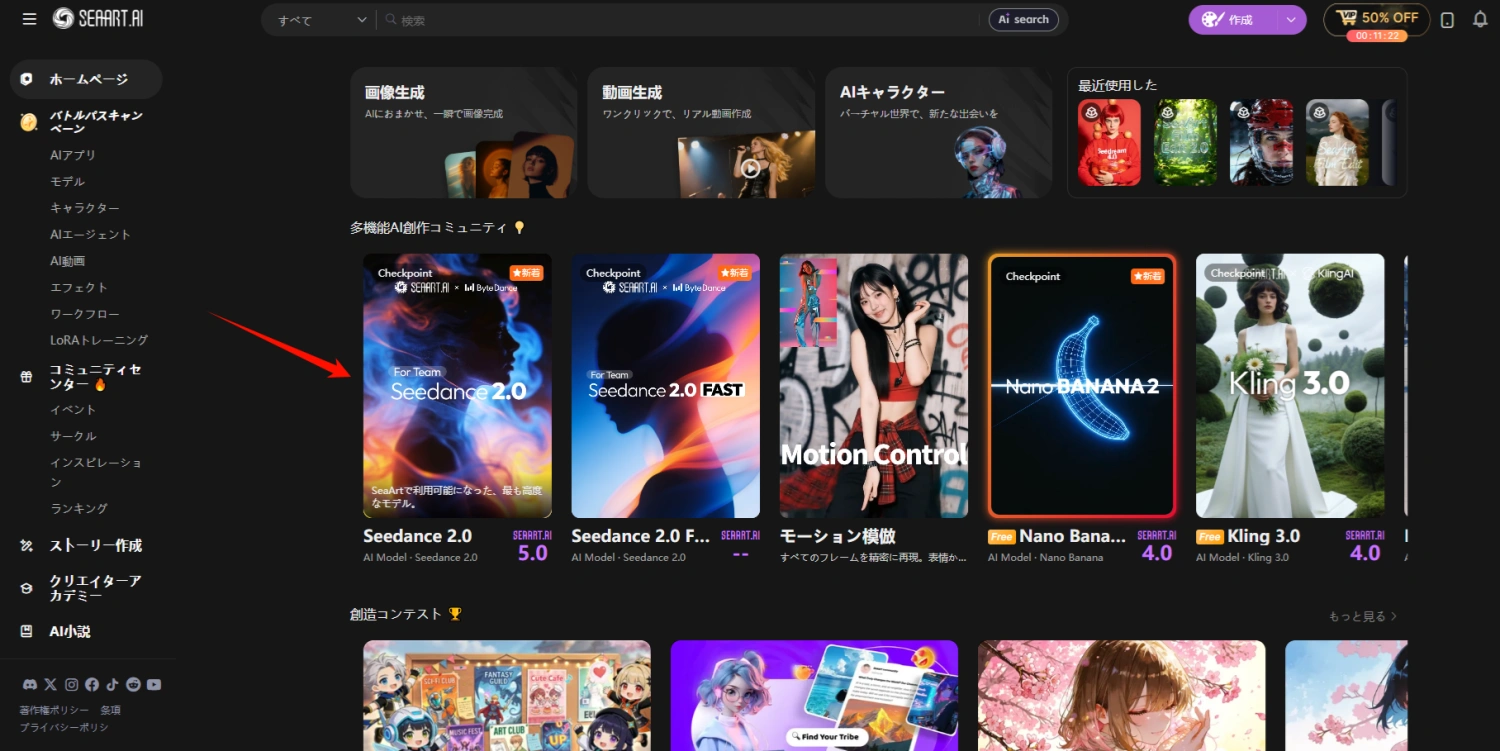

SeaArt AIでのSeedance 2.0の使い方

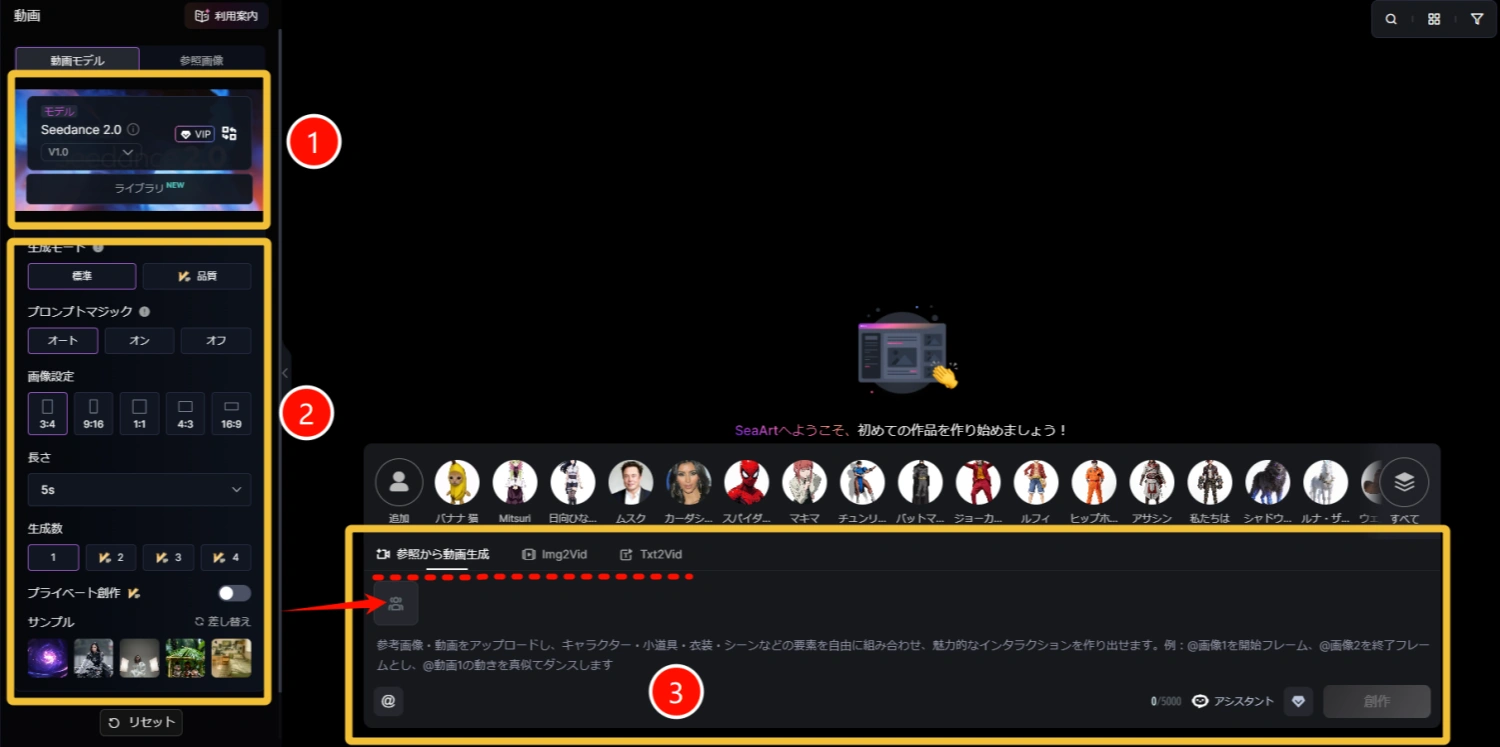

使えるモデルは2種類、Seedance 2.0とSeedance 2.0 Fastです。どちらかを開いて、以下の3ステップで進めます。

ステップ1. モードを選ぶ

プロンプトエリアに3つのタブがあります。

● 参照から動画生成:画像や動画をアップロードして@タグで指定。キャラクター・小道具・シーンを組み合わせる

● Img2Vid:1枚の画像をアップロードして動きを記述する

● Txt2Vid:アップロード不要で、プロンプトだけで生成する

ステップ2. 素材をアップロードしてパラメーターを設定する

参照から動画生成モードでは、アップロードしたファイルに自動でタグが付きます(@画像 1、@画像 2、@動画 1)。プロンプトでそのまま参照できます。アスペクト比(3:4、9:16、1:1、4:3、16:9)、尺(4秒~15秒)、生成モード(標準または品質)を設定します。

ステップ3. プロンプトを書いて生成する

動き、カメラの方向、雰囲気、音声の指示を記述します。アップロードしたファイルは必要に応じてタグで参照します。最後に、「創作」を押して、完了したら結果ビューからダウンロードします。

Seedance 2.0のプロンプトの書き方

Seedance 2.0は、以前のバージョンと比べて、書いた指示をより忠実に実行します。全体の雰囲気をなんとなく反映するのではなく、具体的な指示の一つひとつをきちんと拾ってくれます。

【関連記事】Seedance 2.0プロンプト20選 - コピペですぐ使える

複数の参照ファイルを使うときは、各ファイルの役割を指定する

ファイルをアップロードしてもコンテキストを伝えなければ、モデルはその目的を推測するしかありません。各参照が何をコントロールするかを明確に指定することが大切です。

Show the dancer from image1 performing on stage. Use the choreography and movements shown in video1. Set the scene in the studio environment from image2. Sync each movement transition to the beat of audio1. Cinematic style, warm stage lighting.

@image1 のダンサーがステージで踊っている様子を映してください。振り付けと動きは @video1 を参考にしてください。背景は @image2 のスタジオ環境にしてください。各動作の切り替えを @audio1 のビートに合わせて同期させてください。シネマティックなスタイル、暖かいステージ照明。

マルチショットにはタイミングブロックを使う

各セグメントを正確な時間範囲で区切ります。モデルはこれをショットの境界として読み取り、カット間で一貫した連続シーンを生成します。

Strong rhythmic music-driven montage with fast cuts, slow motion, macro, and time-lapse. Audio: beats, bass pulses, breathing, ambient sounds only-no dialogue. 0-5s: Fast cuts montage - white flower blooming in extreme macro slow motion, green aurora dancing over lake with perfect reflection, ballet dancer en pointe mid-spin on black stage, butterfly wing scales shimmering in golden light, volcanic eruption with lava bursting upward. 5-10s: Fast cuts montage - humpback whale diving vertically underwater with sunlight rays piercing through deep blue ocean, Milky Way galaxy mirrored perfectly on still lake with lone figure at horizon, golden hour wheat swaying in backlight with warm bokeh, then cut to black screen with center frame minimalist white text: SEEDANCE 2.0

強いリズムの音に合わせたモンタージュ。高速カット、スローモーション、マクロ、タイムラプスを混ぜる。音はビート、低音の脈動、息づかい、環境音のみ。セリフなし。0〜5秒:高速カットのモンタージュ。白い花が咲く瞬間を超マクロのスローで、湖に映り込む緑のオーロラ、黒いステージでつま先立ちで回転するバレエダンサー、黄金の光で蝶の羽の鱗粉がきらめく、火山噴火で溶岩が上に吹き上がる。5〜10秒:高速カットのモンタージュ。深い青の海中でザトウクジラが垂直に潜り、太陽光の筋が差し込む。静かな湖面に天の川が鏡のように映り、地平線にひとりの人物。逆光のゴールデンアワーで小麦が揺れ、暖かいボケ。最後は黒画面に切り替え、中央にミニマルな白文字でSEEDANCE 2.0

カメラコントロールには撮影用語を使う

Seedance 2.0は標準的な映画用語に正確に反応します。以下はどれも安定して機能します。

| 用語 | 効果 |

| Push-in | カメラが被写体に向かって前進 |

| Pull-out / pull-back | カメラが後退して広い文脈を見せる |

| Orbit shot | 固定された被写体の周りをカメラが回る |

| Tracking shot | 動く被写体をカメラが追う |

| Dutch angle | カメラを傾けて緊張感を演出 |

| Shallow depth of field | 被写体にピント、背景はボケ |

| Handheld feel | わずかなカメラブレで、よりリアルな質感 |

Seedance 2.0:すぐ使えるプロンプト例

Seedance 2.0の実力を示す、実際に効果のあったプロンプト例です。それぞれ異なる機能をターゲットにしています。

1. SFキャラクターのショーケース

プロンプト例

Use @image1 as facial reference. Keep face completely consistent-do not alter features or expression. Style: BLACK SUN sci-fi aesthetic, dark photography, biomechanical design, shallow depth of field. Character: Black biomechanical coat + black lining, ocean wave curls, exposed neck, feminine features, waist, high-level metallic sci-fi lighting, intricate technical patterns in fabric. Environment: Outdoor wasteland, gray-blue sky, windy. Camera: Medium fixed position, 30-degree side angle, slow upward pan and push-in, uncut continuous take, smooth slow-motion quality. Logo: Small 'HENSHIN' text in corner (whispered). Transformation: Deep red micro-light + dark neon glowing text, body shifts pose slightly, seamless execution. Effects: Dark bio-matter + black geometric glowing patterns, metallic texture, animated growth, subtle particles, red highlights. End: Hold final pose 3 seconds, cool texture finish."The facial consistency is insane - every frame maintains the exact same features from the reference image

@image1 を顔の参照として使用してください。顔は完全に一貫させ、特徴や表情を変更しないでください。スタイル:BLACK SUN のSF美学、ダークな写真表現、バイオメカデザイン、浅い被写界深度。キャラクター:黒いバイオメカコート+黒い裏地、波のようなカール髪、首元が見える、女性的な特徴、ウエスト、金属的なハイレベルSFライティング、布地に精密な技術パターン。環境:屋外の荒野、灰青の空、風が強い。カメラ:ミディアムの固定位置、30度の斜め角度、ゆっくり上方向にパンしつつプッシュイン、ワンカットの連続撮影、滑らかなスローモーション品質。ロゴ:画面端に小さく HENSHIN の文字(ささやくように)。変身:深い赤の微細な光+暗いネオン発光テキスト、身体がわずかにポーズを変え、継ぎ目なく実行。効果:暗いバイオ物質+黒い幾何学の発光パターン、金属テクスチャ、成長アニメーション、控えめな粒子、赤いハイライト。終わり:最終ポーズを3秒キープし、クールな質感で仕上げる。

顔の一貫性は驚異的です。すべてのフレームで、参照画像の特徴がそのまま保たれています。

他のAI動画モデルで似たSFプロンプトを試したことがありますが、途中で顔が崩れたり、ポーズの切り替えがおかしくなったりすることがよくありました。このモデルは、しっかり決めてきます。

2. 京劇のパフォーマンス

プロンプト例

Use @image1 as the reference for Chinese opera performer. Traditional stage, dim lighting. Camera starts with close-up, slowly rotates around her in slow motion, revealing costume details. She remains still, eyes locked on camera. Quick cut to side view, normal speed. She raises her arms in classic opera gesture, sleeves flowing gracefully. Camera slowly dollies in as she turns toward camera, ornaments sparkling under stage lights. Switch to extreme slow motion, wide shot. She extends both arms outward, sleeves billowing in the air, flowing silk brushing past the camera lens. Warm stage lighting, cinematic style.

@image1 を京劇役者の参照として使用。伝統的な舞台、薄暗い照明。カメラはクローズアップから始まり、彼女の周りをゆっくり回転しながらスローモーションで衣装のディテールを見せる。彼女は静止したままで、目はカメラを見つめる。素早いカットで側面へ、通常速度。彼女は両腕を上げ、古典的な京劇の所作で袖を優雅に流す。カメラがゆっくりと寄り、彼女がカメラの方へ向くと、装飾品が舞台照明の下で輝く。極端なスローモーションに切り替え、ワイドショット。彼女は両腕を外側へ広げ、袖が空中に膨らみ、流れるシルクがカメラレンズをかすめる。暖かい舞台照明、シネマティックなスタイル。

アングルの切り替えも自然で滑らかです。ランダムなAI生成のつなぎではなく、本物の撮影技術を感じさせます。

3. ストーリー性のある動画

プロンプト例

Use @image1 as the opening frame. Camera follows a man in black clothing running at high speed, escaping urgently. A group of police officers chase behind him. Camera switches to side tracking shot, maintaining pace with the runner. In his panic, he crashes into a fruit stand on the roadside, scattering produce everywhere. He scrambles to his feet and continues running. Background: panicked crowd reactions and police siren sounds wailing.

@image1 をChinese operaの演者の参照として使用してください。伝統的な舞台、薄暗い照明。カメラはクローズアップから開始し、スローモーションで彼女の周りをゆっくり回り込み、衣装のディテールを見せる。彼女は静止し、目線はカメラに固定。素早く横からのアングルへカットし、通常速度。彼女はChinese operaの定型的な所作で腕を上げ、袖が優雅に流れる。彼女がカメラのほうへ向き直るのに合わせて、カメラはゆっくりドリーインし、舞台照明の下で装飾がきらめく。極端なスローモーションに切り替え、ワイドショット。彼女は両腕を外側へ伸ばし、袖が空中で膨らみ、流れる絹がカメラレンズのすぐそばをかすめる。暖かい舞台照明、シネマティックなスタイル。

正面から側面へのカメラアングルの切り替えがシームレスです。ランダムなカットではなく、ちゃんとした撮影になっています。

さらにすごいのが、フルーツスタンドに激突したときのディテールです。リンゴやオレンジが個別に、リアルな勢いで別々の方向に散らばります。

他のAI動画モデルで追跡シーンを何十回も回してみましたが、ありえないポーズで走ったり(脚が変な方向に曲がるなど)、衝突の物理挙動がおかしかったりしました。この動画のスローモーションのタイミングは完璧です。

Seedance 2.0で変わるAI動画制作、手作業のつなぎ編集はどこまで減るのか

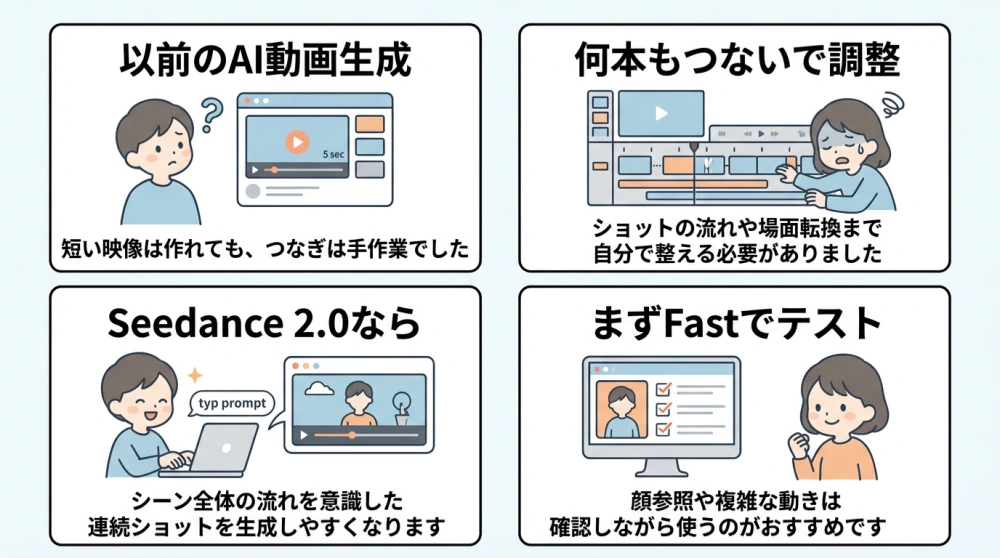

以前のAI動画モデルで一番の問題だったのは、品質ではなく構成でした。5秒のクリップを生成すると、単体ではきれいに見えます。しかし、始まり・中間・終わりを持ったシーンをつなぎ合わせるには、何十ものクリップを手動でつなぎ、自分でショットリストを書き、トランジションを一つひとつ合わせる必要がありました。AIは映像素材を生成するだけで、あとは全部自分でやる形です。

Seedance 2.0はそれを変えました。ナレーティブ(キャラクター、状況、出来事の流れ)を描写すると、モデルは一貫したキャラクター、揃った照明、シーケンス全体を通じた一貫したつながりを持つ連続ショットを生成します。かつて自分がAIのポストプロダクション編集者だったとしたら、今はAIが撮影監督として機能します。あなたの仕事はストーリーを明確に伝えること。撮り方はモデルが考えます。

音声も同様です。セリフ、環境音、効果音は映像と並行して生成され、後からではなくアクションに合わせて配置されます。多くの短尺コンテンツでは、出力そのものがほぼ完成品として仕上がります。

ひとつ覚えておいてほしいことがあります。顔の参照は正面向きのクリーンなポートレートで最もよく機能します。横顔や低解像度の画像はフレーム間でズレやすい傾向があります。また、液体・布・詳細なオブジェクトのインタラクションといった複雑な物理表現のクローズアップは、以前のモデルより改善されていますが、確認なしで本番素材として使うには、まだ慎重さが必要です。Seedance 2.0 Fastバージョンで先にテストするのがおすすめです。

Seedance 2.0に関するよくある質問

SeaArt AIでSeedance 2.0を使うには有料アカウントが必要ですか?

Seedance 2.0はクレジット制で利用できます。継続的に使う予定がある場合は、有料プランに加入しておくと、月間クレジット数や優先キューの面で余裕が出ます。テスト生成を数本試す程度であれば必須ではありませんが、ある程度の本数を継続して作るなら、検討する価値があります。

SeaArt AIのFastバージョンは別モデルですか?

いいえ、同じ基盤モデルをもとに動作しています。

SeaArt AIのFastバージョンでは、生成速度が速く、クレジット消費も抑えられます。全体的な品質は近いものの、細かなディテールの再現では標準版のほうが安定しやすいです。アイデア出しや構成確認にはFastを使い、最終出力では標準版に切り替える使い方が効率的です。

既存の動画をアップロードして特定の部分を編集できますか?

はい、可能です。プロンプト内で動画を@video1として参照し、変更したい内容を指定します。キャラクターの差し替え、動きの修正、特定シーンの調整などに対応できます。どの程度元の動画の要素を残したいかによって仕上がりは変わるため、まずはFast設定でテストするのがおすすめです。

Seedance 2.0のマルチショット一貫性はどのような仕組みですか?

ByteDanceは、音声と動画を別々に学習してあとから組み合わせるのではなく、ネイティブなマルチモーダルアーキテクチャとしてSeedance 2.0を設計しています。さらに、長い文脈を扱うために使われるROPEポジショナルエンコーディングを取り入れることで、カットをまたいだセマンティックな連続性を保ちやすくしています。

これにより、1つのプロンプトから15秒のマルチショット動画を生成した場合でも、最初のショットと後半のショットでキャラクターの見た目や雰囲気をそろえやすくなっています。

1回の生成で参照できるファイル数はいくつですか?

1回の生成で参照できるのは最大12ファイルです。内訳は、画像9枚、動画3本、音声3本までとなっています。

実際には、参照ファイルを7つ以内に抑えたほうが、結果が安定しやすい傾向があります。それ以上になると、モデルが一部の入力を十分に反映しにくくなる場合があります。

Seedance 2.0は商用プロジェクトに使えますか?

商用利用を検討している場合は、SeaArt AIの最新の利用規約を必ず確認してください。AI生成動画のライセンス条件は、モデルや提供内容の更新にあわせて変わることがあります。

基本的にはSeaArt AIの利用規約が適用されますが、公開や納品の前に最新条件を確認しておくと安心です。

おわりに

5年前、CMを撮るには何が必要だったかを思い浮かべてみてください。スタジオ、照明スタッフ、役者、機材レンタル。雨が1日降るだけで、撮影スケジュール全体が崩れることもありました。それが当時の当たり前であり、十分な予算を確保できる企業にしか手が届きにくい世界でした。

しかし、いまはそのハードルが急速に下がっています。強いアイデアと明確なプロンプトがあれば、かつては中規模の制作予算が必要だった表現にも手が届きます。アクション演出、シネマティックなシーケンス、音声に合わせたカットまで、そうした映像表現がすでにプラットフォーム上で生み出されています。

もちろん、モデルがクリエイティブな判断そのものを代わりにしてくれるわけではありません。あくまで、それを形にするための手段です。何を作りたいのか、そしてそれをどれだけ明確に言語化できるか。その部分が結果を左右するという点は、今も変わりません。

このモデルはSeaArt AIですぐに使えます。思い描いた映像があるなら、ここから始めてみてください。