Seedance 2.0は使える?マルチモーダル生成の精度と特徴を本音レビュー

AIで動画を作るとき、参考動画をアップロードして「このカメラワークをコピーして」と指定しても、画角やリズムが微妙にズレてしまい、期待外れに終わることがよくあります。

もし、提供した参考素材を真に理解し再現できるAIがあったら、試してみたいと思いませんか?

それが今回紹介するマルチモーダル動画生成モデル、Seedance 2.0です。ByteDanceが間もなくリリースする次世代の主力モデルですが、これまでの「1.5 Pro」とは一線を画します。以前は開始・終了フレームでの制御が中心でしたが、Seedance 2.0は画像、動画、音声を同時に処理できる真のマルチモーダルを実現しており、最大12個のファイルを同時に追加できます。

実際に3日間ほど集中してテストしてみましたが、その実力には正直驚かされました。

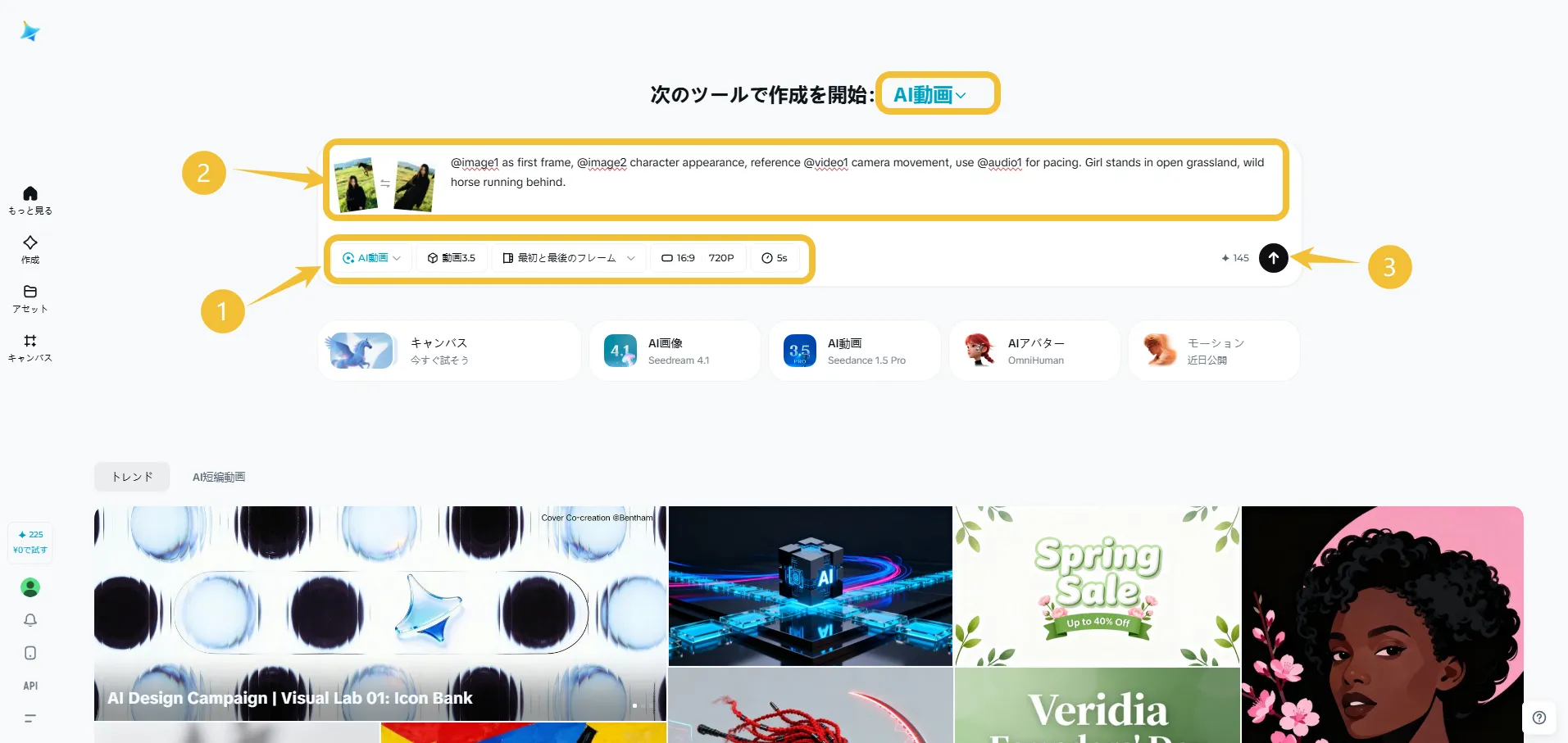

Seedance 2.0の最大の強みは、アップロードした素材をプロンプト内で「@」を使って自由に組み合わせられる点です。

たとえば、自分のアップロードした素材に対して以下のような指示が出せます。

● 「@画像1 を最初のフレーム、@画像2 を最後のフレームにする」

● 「@画像3 のキャラクターに、@動画1 のダンスを踊らせる」

● 「@画像4 の服装を、@画像5 の人物に着せる」

単に動画を作るだけでなく、キャラクター、動き、服装、背景といった要素を別々の素材から拾い上げ、パズルのように組み合わせて新しい映像を作り出せるのが特徴です。AI任せにするのではなく、まるで監督のように「誰に・何を・どうさせるか」を細かくコントロールできます。

正直に言うと、10回生成テストを行ったうち、6回はファイル数上限のエラー、2回はシステムエラーが出ました。まだ不安定な部分はありますが、正常に生成されたときの「再現度」に関しては、既存モデルと比べて明らかに頭一つ抜けています。

現在、SeaArt AIではSeedance 1.5 Proがすでに利用可能ですが、この2.0バージョンも間もなく実装される見込みです。すぐに試してみたい方は、こちらからチェックしてみてください。

Seedance 2.0は何が違う?

具体的な使い方の前に、普段使っている他の動画生成ツールと比べて、2.0がどう進化しているのか整理してみました。

| 機能 | Seedance 1.5 Pro | Seedance 2.0 |

| 入力方式 | 開始フレーム / 終了フレームのみ | マルチファイル参照(画像 + 動画 + 音声) |

| 最大参照数 | 2枚(開始/終了) | 最大12ファイル(画像9枚 + 動画3本 + 音声3本) |

| カメラ制御 | テキスト指示のみ | 動画参照(@video)による精密制御が可能 |

| 音声生成 | 動画と同時生成 | 同時生成 + 参照音声による制御も可能 |

| マルチアングル | 1つの連続したショット | 1つのプロンプトで複数アングル構成が可能 |

| 一貫性 | ショット内では安定 | カットが変わってもキャラや背景が維持される |

| 解像度 | 1080p | 1080p |

Seedance 2.0の注目すべきポイント3つ

1. プロンプト1つで「マルチアングル」の動画が作れる

これまでは複数のクリップを作って編集ソフトでつなぐ必要がありましたが、Seedance 2.0ではプロンプト内でカメラの切り替えを指示するだけで、一連の流れを持った動画が生成されます。

実際に3つのシナリオでテストしてみましたが、カットの切り替わりは自然で、別の角度になってもキャラクターの顔や服装が崩れず、最初から編集された映像のように見えました。

2. 音声と口の動きが最初から合っている

動画と音声が同時に生成されるため、キャラクターが喋るシーンでも口の動きが自動で合います。

日本語と英語の両方で試しましたが、どちらも手動修正がいらないレベルで口パクが合っていました。

3. 生成時間とコスト

実際のテストでは、約15秒の動画を生成するのに5~6分ほどかかりました。

1回でうまくいけば問題ありませんが、プロンプトを調整しながら何度か作り直すとなると、待ち時間やコストはやや気になってきます。

Seedance 2.0の制限

Seedance 2.0を利用する際の、ファイル数や長さの上限は以下の通りです。

- 画像:最大9枚まで

- 動画:最大3ファイル(合計15秒以内)

- 音声:最大3ファイル(MP3形式、合計15秒以内)

- 総ファイル数:全種類合わせて最大12個まで

- 出力動画の長さ:4秒~15秒(自由に選択可能)

- 内蔵オーディオ機能:効果音やBGMの自動生成に対応

Seedance 2.0の仕組みと2つの入力モード

Seedance 2.0には、大きく分けて2つの入力モードが用意されています。「開始/終了フレームモード」と「フルリファレンスモード」です。

① 開始/終了フレームモード

1〜2枚の画像をアップロードして「最初のフレーム」と「最後のフレーム」を設定し、テキストプロンプトを入力するだけで完了します。Seedance 1.5 Proをすでに使っている方なら、このワークフローはお馴染みのものでしょう。最初と最後さえ決めれば、その間の動きはモデルがいい感じに生成してくれます。

② フルリファレンスモード

こちらが2.0の真骨頂とも言える革新的な機能です。

画像で「ビジュアルスタイル」を、動画で「キャラクターの動きやカメラワーク」を、そしてオーディオで「リズムやペース」を指定できます。

プロンプト内で「@ファイル名」という構文を使うことで、各ファイルの参照元を指定できるのが特徴です。

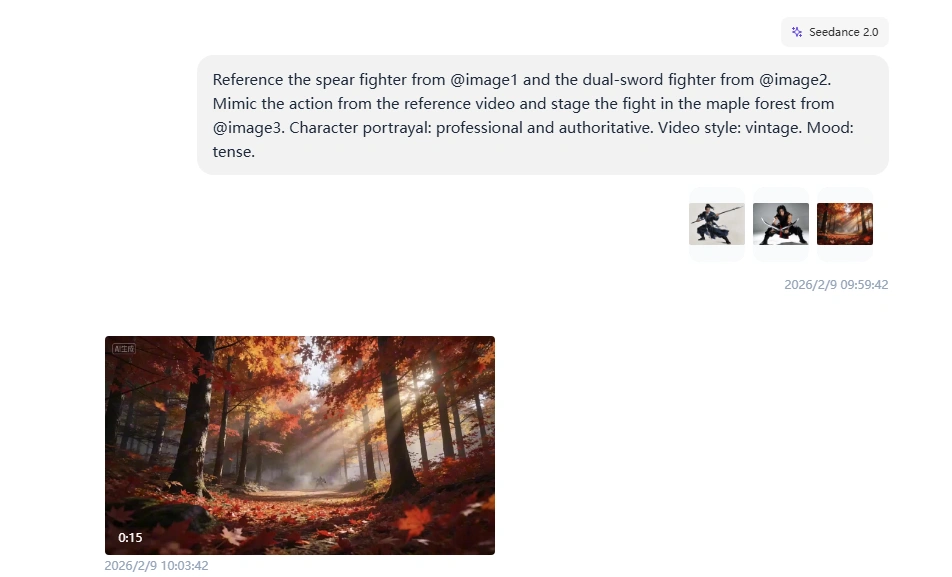

検証1:Seedance 2.0複数キャラクターのコレオグラフィー制御

複雑な戦闘シーンをどうコントロールするか。いろいろ試した結果、最もきれいに生成できたのが「画像で各キャラクターの外見を固定し、1つの参照動画でタイミングと動きを駆動させる」という方法でした。

プロンプト例:

Reference the spear fighter from @image1 and the dual-sword fighter from @image2. Mimic the action from the reference video and stage the fight in the maple forest from @image3. Character portrayal: professional and authoritative. Video style: vintage. Mood: tense.

@image1 の槍使いと、@image2 の双剣使いを参照。参照動画のアクションを模倣し、@image3 の紅葉の森で戦わせる。キャラクター描写はプロフェッショナルかつ威厳を持って。映像スタイルはヴィンテージ風。緊張感のあるムードで。

このように書くだけで、AIはかなり自然に役割を読み取ってくれました。

● @image1/@image2 → キャラクターの外見

● @video1 → モーションの参考

● @image3 → 背景設定

「これはキャラ用」「これは背景用」と明示しなくても、文脈から推測してくれます。 この点はかなりスマートです。

⚠️ 実際にやってみて分かった注意点

複数ファイルを使う場合は、それぞれの役割をはっきり書いた方が安定します。

試しに

「@video1と@video2を使う」とだけ書いてみたところ、結果はかなりバラつきました。12回テストしたところ、

● 具体的に役割を書いた場合 → 11回成功

● 曖昧に書いた場合 → 4回成功

という差が出ました。

評価

✅ 良かった点

● 参照動画の攻撃パターンや構えをかなり忠実に再現

● 紅葉の森の背景が途中で崩れない

● キャラクター衣装も安定特に「動きの再現性」は想像以上でした。

❌ 気になった点

● 参照動画の尺が短かったため、後半はAIの自動補完になりました。

● そこだけやや動きが不自然に感じられます。(使用素材:画像3枚+動画1本)

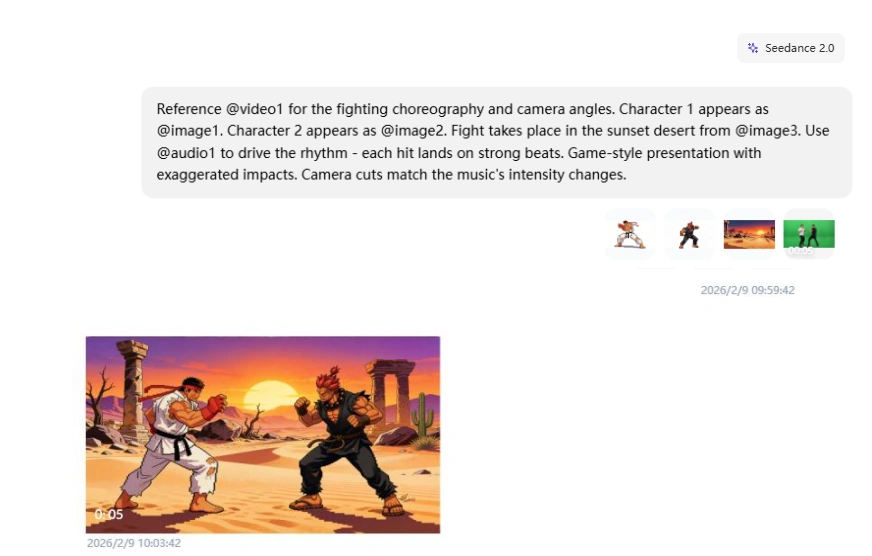

検証2:Seedance 2.0音ハメ編集のテスト

ミュージックビデオ風のコンテンツを作るコツは、オーディオに編集を主導させることです。

手動でビートに合わせてマーカーを打つような面倒な作業は必要ありません。リズムに合わせてヒットさせると指示するだけで、AIがタイミングを合わせてくれます。

プロンプト例:

Reference @video1 for the fighting choreography and camera angles. Character 1 appears as @image1. Character 2 appears as @image2. Fight takes place in the sunset desert from @image3. Use @audio1 to drive the rhythm - each hit lands on strong beats. Game-style presentation with exaggerated impacts. Camera cuts match the music's intensity changes.

戦闘の動きとカメラアングルは @video1 を参照。キャラ1は @image1、キャラ2は @image2。場所は @image3 の夕暮れの砂漠。@audio1 でリズムを駆動させ、強拍に合わせて打撃をヒットさせる。ゲーム風の演出で衝撃を誇張。曲の盛り上がりに合わせてカメラをカット割りする。

評価

✅ 良かった点

● 打撃のタイミングがビートにしっかり合う

● キャラの見た目が最後まで崩れない

● 背景と影の整合性も良好

● カメラカットも音楽の強弱にリンク

いわゆる「それっぽい」ではなく、ちゃんと意図を感じる編集でした。

❌ 気になった点

● 激しい動きのつなぎ目で、ごく一部フレームに歪みが出ることがありました。

● ただ、停止して見ないと分からないレベルです。

実際にSeedance 2.0を試して分かったこと

Seedance 2.0を検証する中で、かなりの回数テストを回しました。

その中から、「ここはコントロールしやすい」「ここから崩れやすい」という傾向が見えた代表的なケースを紹介します。

テスト① 複雑な動きでもキャラクターは崩れないか?

まずは、複数シーンにまたがるストーリーの中で、 キャラクターの見た目がどこまで維持されるかを検証しました。

プロンプト:

Man @image1 walks down hallway after work, tired, slowing down. Stops at front door. Close-up face, man takes deep breath, adjusts mood, hides negative emotions, becomes relaxed. Close-up finds key, inserts into lock. Enters home. His daughter and pet dog run over happily to hug him. Interior is warm. Natural dialogue throughout.

仕事帰りの男@image1が疲れた様子で廊下を歩き、足取りが重くなる。玄関の前で立ち止まり、深呼吸をしてネガティブな感情を隠し、表情を緩める。鍵を取り出してドアを開ける手元のアップ。家に入ると、娘と愛犬が嬉しそうに駆け寄ってきて彼に抱きつく。室内は温かい雰囲気。自然な会話のやり取り。

✅分かったこと

「ロングショット」「クローズアップ」「スムーズなトラッキング」といった具体的なカメラ指示を入れると、ただ漫然と続く映像ではなく、意図のあるシーンとして成立しやすくなります。

⚠️ 崩れやすいポイント

キャラクターの参照画像(@image1など)を指定しないと、カットごとに顔や服装が微妙に変わることがあります。

また、余計なモブキャラを登場させると主役の描写がブレるので、登場人物は最小限に絞るのがコツです。

テスト② 映画のような「マルチショット」構成を作る

単に「女性がコーヒーを飲む」だけではなく、映画のようなカメラワークと照明演出ができるか試しました。プロンプトで監督のような指示を出します。

プロンプト:

Golden hour, a warm modern coffee shop cinematic shot sequence. Opening wide exterior establishing shot with warm lights; soft bokeh glows through large glass windows. Cut to a close-up: an elegant woman in smart casual enters from the lower left, gently pushing the door. The camera follows her with a smooth tracking shot as she walks across the wooden floor toward the window. She approaches a table and sits down. Transition into a medium close-up: she lifts a ceramic coffee cup to her lips and takes a quiet sip. Soft natural window light illuminates her face. Warm color grade, shallow depth of field, creamy cinematic bokeh background, fluid camera movement, 16:9 aspect ratio.

デンアワー、温かみのあるモダンなカフェの映画風シーケンス。冒頭は暖色の光が溢れる外観のロングショット。大きなガラス窓越しに柔らかなボケ味が輝く。クローズアップにカット:スマートカジュアルな服装の優雅な女性が左下から入り、ドアを優しく押して入店。彼女が木の床を歩いて窓際へ向かうのを、滑らかなトラッキングショットで追う。テーブルに近づき、着席する。ミディアム・クローズアップへ移行:彼女は陶器のコーヒーカップを口元へ運び、静かに一口飲む。窓からの柔らかな自然光が彼女の顔を照らす。温かいカラーグレーディング、浅い被写界深度、クリーミーで映画的な背景ボケ、流れるようなカメラワーク、アスペクト比16:9。

✅分かったこと

テスト1と同様、カメラワーク(ロング→アップ→追従)を細かく指定することで、非常に映画的な没入感のある映像になりました。特に照明の指定が効いており、安っぽいCG感が消えました。

⚠️ 崩れやすいポイント

キャラの参照画像がない場合、顔や服装の一貫性はやや不安定になります。

余計な要素を足さず、シンプルにまとめた方が結果は安定しました。

テスト③ 参照動画なしで「音ハメ」カット割りに挑戦

参照動画(@video)を使わず、音楽(@audio)のリズムだけで映像の切り替えタイミングを制御できるかテストしました。

プロンプト:

Use @audio1 for pacing and cut timing. @image1 = dancer identity/outfit; @image2 = night street location/lighting. 12s fast-cut montage, cuts land on strong downbeats: 0-4s low-angle footwork close-ups (shoes + wet pavement reflections), 4-8s stable centered medium shot (one clean spin move), 8-12s wide shot (finish + small crowd reaction). Vintage cinematic look: 35mm film grain, subtle halation, high contrast, neon + warm streetlight mix. Keep dancer consistent; no warping hands, no broken limbs, no camera jitter.

@audio1 のペースに合わせてカットを切り替える。ダンサーの服装は @image1、夜のストリートの背景は @image2 を参照。12秒間の高速モンタージュ。強いダウンビートに合わせてカット。0-4秒:足元のステップのローアングル・アップ(靴と濡れた路面の反射)。4-8秒:安定したミディアムショット(きれいなスピン動作)。8-12秒:フィニッシュと観客の反応(ロングショット)。35mmフィルム風のヴィンテージな質感、高コントラスト、ネオンと街灯のミックス。ダンサーの手足が崩れないように。

✅ 分かったこと

4/4拍子のようなハッキリしたビートの曲なら、ほぼ正確にダウンビートでカットが切り替わります。

逆にリズムが曖昧な曲だとタイミングがズレやすく、意図したモンタージュになりにくい印象でした。

Seedance 2.0が真価を発揮する3つの実用シーン

テスト結果とモデルの特性を踏まえると、特に以下のシーンで制作の悩みを解決してくれます。

1. EC・商品紹介動画

商品デモ動画には、ブランドの一貫性、スムーズなカメラワーク、そして音に合ったテンポが不可欠です。商品の静止画(@image)、プロっぽい動きの参考動画(@video)、BGM(@audio)をアップロードすれば、Seedance 2.0がそれらを統合し、SNS広告でそのまま使える10~15秒の高品質なクリップを生成してくれます。

✅ ここがすごい:

ブランドカラーやロゴの位置、カメラアングルを正確にコントロールできます。「AIが運よく正解を出してくれるまで20回リトライする」という無駄な時間がなくなります。

2. 映画のようなショートムービー制作

シネマティックな映像を作るには、一貫したキャラクター、明確なショット構成、意図のある間の3つが必要です。

Seedance 2.0は、プロンプトで「ロングショット」「クローズアップ」「肩越しショット」などを明確に指定し、シーンの制約を厳密にするほど強力な威力を発揮します。

✅ ここがすごい:

バラバラのクリップをつなぎ合わせる必要はなく、1つのプロンプトからちゃんとつながった映像の流れを一発で作れます。

カットをまたいでも主人公の顔や雰囲気が崩れにくく、安心して作業できます。

3. キャラクター主導の物語コンテンツ

短編映画や連続ドラマ風のコンテンツでは、複数のショットにまたがって「同じキャラクター」であり続けることが求められます。

「帰宅する男性のシーン」のテストでは、6つの異なる角度や照明でも、顔や表情がバラバラになることなく、自然に見せられました。

✅ ここがすごい:

1回の生成で、引きの画(ロング)から寄り(アップ)、肩越しなど、複数のアングルをカバーできます。編集で繋いだときに違和感が出ない素材が手に入ります。

Seedance 2.0で高品質な動画を作るコツ

10回以上の生成テストを通じて見つけた、確実にクオリティを上げるテクニックを共有します。

1. プロンプトは「秒数」で区切る

「女性が歩いて振り返る」と書くより、「女性が3秒間歩き、立ち止まり、2秒かけて振り返る」と書くほうがAIに伝わります。具体的な時間の指定は、AIにとって最強の指示書になります。

2. カメラの動きを具体的に説明

「面白いカメラワーク」と書いてもAIには伝わりません。「カメラを左にパンしながら少しズームインする」のように、物理的な動きを言葉にしましょう。可能であれば、テキストで説明するより、似た動きをしている参考動画を入力するのが確実です。

また、複雑なアクションは「パルクールをする」と一言で済ませず、以下のように秒数で区切って分解すると、動きが滑らかになります。

✅ 良い例:

「キャラクターが走る(0-5秒)、障害物を飛び越える(5-8秒)、着地して回転する(8-12秒)」

3. 参照ファイルの「黄金比」を知る

テストの結果、参照ファイルは以下の枚数・秒数が最も安定しました。

①画像:

キャラクターの一貫性を保つなら1~2枚がベストです。3枚以上入れると、AIがどの特徴を優先すべきか迷ってしまい、顔が崩れやすくなります。

「正面1枚+横顔1枚」の組み合わせがおすすめです。

②動画:

参考動画は10秒以内(理想は8~10秒)に留めましょう。

仕様上は15秒までいけますが、長すぎるとAIが動きの解釈をミスしたり、重要なアクションを見落とすことがあります。

③音声:

BGMに明確なビートがあれば、わざわざプロンプトで「音楽に合わせて」と指示しなくても大丈夫です。AIが自動的にリズムを検知し、映像の動きを合わせてくれます。

拡張機能と新規生成、どちらを使うべき?

動画を作っていて、「この先どうしよう?」と迷ったときの判断基準をまとめました。

1. 拡張機能を使うべき時

すでにクオリティの高いベース動画があり、その「アクションの続き」を作りたい場合におすすめです。

キャラクターの見た目は、2~3回(合計40秒程度)までなら崩れずに維持できますが、それ以上長くなると少しずつ顔が変わってしまうことがあります。

2.新規生成すべき時

カメラアングルやシーンをガラッと変えたい場合は、無理に拡張せず、新しく作り直しましょう。

拡張機能はあくまで「動きの継続」には強いですが、「視点の変更」には向いていません。

3.編集機能を使うべき時

動きや背景はそのままで、「キャラクターだけ変えたい」、あるいは「背景だけ変えたい」という場合です。

一から作り直す必要がないため、今回のテストではこれで試行回数を5~10回減らすことができ、大幅な時短になりました。

動画の拡張機能:単なる延長ではなく「シーンの続き」を描写

最初は動画拡張の長さの設定方法がよく分かりませんでした。後で気づいたのは、

「@video1を10秒拡張する」と指示する場合、設定する生成時間は「新たに追加する部分の長さ(10秒)」であり、元の動画を含めた合計時間ではない、ということです。

拡張プロンプト例:

Extend @video1 by 10 seconds. [Describe what happens in the NEW 10-second portion]

@video1 を10秒拡張する。[ここから新しく起こる10秒間の出来事を描写]

設定:生成時間 = 10秒

実際のテスト例:カフェのシーンの続き

テスト2で作った「女性がカフェでコーヒーを飲むシーン(15秒)」の続きを作ってみました。

プロンプト:

Extend @video1 by 10 seconds. She sets the cup down, exhales quietly, then stands up. She walks to the counter to pay, exchanges a few words with the barista, and exits the cafe. End on a wide shot from across the street as she steps into the golden hour light.

@video1 を10秒拡張する。彼女はカップを置き、静かに息を吐いて立ち上がる。カウンターへ歩いて支払い、店員と二言三言交わして店を出る。最後は、ゴールデンアワーの光の中、通りの向こう側から撮ったロングショットで終わる。

結果:元の15秒(入店~着席~一口飲む)に、新たに10秒(退店~ラストシーン)が追加され、自然に繋がりました。キャラクターの見た目は3回の拡張を通して維持されましたが、服の色など細かいディテールが少し変わってしまうことがありました。

🙌解決策:面倒でも、拡張するたびにプロンプト内で「服装やスタイルの指定」を繰り返し書くこと。これで一貫性が保たれます。

動画内のキャラクターだけ入れ替える

既存の動画の動きやカメラワークはそのままに、登場人物だけを別のキャラクター(参照画像)に差し替えることも可能です。

体の動き、立ち位置、背景などは維持され、照明も新しいキャラクターに合わせて自動調整されます。

新規生成と同じクレジットがかかりますが、複雑な動き(ダンスやアクション)の動画を一から作り直す手間を考えれば、非常に効率的です。

どこまでやると失敗する?Seedance 2.0の限界テスト

あえて推奨制限を超えた使い方をして、「どこで崩れるか」の境界線を探ってみました。

一度に大量の参照ファイルを追加

最大数である「画像9枚+動画3本」をフルに使って試してみました。

結果は、要素がランダムに混ざってカオスな状態に。画像3のキャラが画像7の背景にいたり、動画1と2の動きがごちゃ混ぜになったりしました。

結論:AIが同時に処理できる指令には限界があります。合計6〜7個までなら安定しますが、8〜9個で怪しくなり、10個を超えると品質がガクンと落ちます。

15秒以上の動画を参照させる

22秒の動画をアップロードしてもエラーにはなりませんが、実際に生成されると、最初の15秒間しか動きが反映されていませんでした。

結論:システム上アップロードできても、AIが見ているのは「冒頭15秒」だけです。長い動画を使う場合は、事前に必要な部分だけトリミングしておきましょう。

画面内のテキストの再現性

「文字の再現度が向上した」とのことですが、実際の商品パッケージで試したところ、小さな文字(24pt以下相当)は潰れて読めませんでした。

ロゴサイズの大きな文字なら、6割くらいの確率で綺麗に出ます。

結論:文字はAIに任せず、動画編集ソフトで後から乗せるのが無難です。

複雑な物理演算(水・炎・煙)

波打ち際のシーンを作ってみましたが、波の砕け方や泡の消え方が不自然でした。Soraのような高度な物理シミュレーションと比べると、まだ「それっぽい動き」の域を出ません。

結論:流体や炎のリアルな挙動をメインにするなら、他のツールや実写素材を検討したほうが良いでしょう。

手の動きのアップ

AI動画の永遠の課題である「手」ですが、やはり完璧ではありません。キーボードを打つシーンを作ったところ、指の位置などは頑張っていますが、動きがぎこちなく、指の数が怪しくなる瞬間もありました。

結論:引きの画(ロングショット)やバストアップなら問題ありませんが、指先の細かい動きにフォーカスしたクローズアップは避けるのが賢明です。

Seedance 2.0に関するよくある質問

Seedance 2.0を使う上で、気になりそうなポイントをQ&A形式でまとめました。

Q. 動画リファレンスを使うと、画像よりもコストがかかりますか?

はい、割高になります。システム上でも警告が出ますが、動画の処理は負荷が高いため消費ポイントが増えます。私のテストでは、15秒の動画を2本生成するのに約120クレジット消費しました。予算が限られている場合は、ここぞという重要なカットでのみ動画リファレンスを使うのが賢明です。

Q. 同じ参照ファイルを使い回せますか?

はい、むしろ推奨します。一度アップロードしたファイルはライブラリに残ります。3枚のキャラクター画像を15回の生成で使い回しましたが、毎回アップロードし直す手間が省けるだけでなく、シリーズ通してキャラクターの顔を統一できるメリットがありました。

Q. AIがどのファイルを使っているか、どうすれば確認できますか?

プロンプトでの「明確な指定」が全てです。「@image1と@video1を使って」のような曖昧な指示だと、AIも混乱して結果が安定しません。「@image1は顔の参考に、@video1はカメラワークの参考に」と具体的に書くことで、成功率は格段に上がります(曖昧な指示と具体的な指示で20回ずつ比較したところ、具体的に書いた方が18回成功しました)。

Q. 動画は何回まで拡張できますか?

実用的な限界は2〜3回までです。4回連続で拡張(合計38秒)してみましたが、2回目までは品質を維持できたものの、3回目で色が少し変わり始め、4回目では明らかに劣化が見られました。ラフ画なら良いですが、納品レベルなら2〜3回の拡張に留めるのが無難です。

Q. Seedance 1.5 Proで作った動画は、2.0でも使えますか?

はい、完全な互換性があります。1.5 Proで生成した動画を、2.0の参照ファイルとしてアップロードし、そこから拡張することも可能です。

つまり、今のうちに1.5 Proで素材を作っておき、2.0が公開されたらそれをベースに作り込むというワークフローが可能です。

Q.「開始/終了フレームモード」と「フルリファレンスモード」の使い分けは何ですか?

複雑さで選びます。

● 開始/終了フレーム:単純な動き(A地点からB地点への移動など)ならこちらが速くて簡単です。

● フルリファレンス:複数の要素(顔、動き、音)を細かく制御したい場合はこちら一択です。

まとめ

Seedance 2.0の登場により、「ドリーショットでゆっくり回転して...」と必死にテキストで説明し、AIが理解してくれるのを祈る時間は終わりを迎えました。これからは「この動画と同じ動きにして」と見せて指定するだけで済みます。

1.5 Proの頃は、思い通りの動画が出る確率は体感で40%程度でしたが、2.0では制限(参照ファイル数など)を守れば70〜80%の確率で一発OKが出せるようになりました。単に機能が増えただけでなく、「制作のコントロール権」がようやく人間の手に戻ってきた感覚です。クライアントワークや本格的なコンテンツ制作において、試す価値は十分にあります。

リリースとアクセスについてByteDance社は当初2026年2月24日のリリースを予定していましたが、マルチモーダル処理の負荷に対応するためのサーバー調整により、日程が調整されています。

本レビューは開発者向けアクセスによる検証結果です。一般公開され次第、順次利用可能になる見込みです。今すぐ動画生成を始めたい方は、SeaArt AIですでにSeedance 1.5 Proが利用可能です。まずはここで基本操作に慣れておき、2.0の公開に備えるのがスムーズな流れでしょう。